Tendências em Inteligência Artificial

Governança de IA e impacto sobre as pessoas

Vídeo: TENDENCIAS EM IA

Índice da publicação

Download Documento

Acesso ao GenMS™ Sybil

A adoção acelerada da IA representa um desafio que transcende o tecnológico: como governar sistemas que evoluem mais rapidamente do que as estruturas organizacionais, como transformar as funções profissionais quando as tarefas mudam trimestralmente e como preservar o julgamento humano em decisões críticas ao mesmo tempo em que se delega a operação de rotina a sistemas autônomos.

Este bloco aborda a dimensão organizacional e humana da IA: os modelos de governança corporativa que estão surgindo para controlar a IA de ponta a ponta, as práticas operacionais avançadas que permitem industrializar sua implantação (MLOps, LLMOps), a transformação de funções e perfis profissionais que já está em andamento, a adoção setorial que transforma a IA em infraestrutura transversal, o impacto na vida diária das pessoas além do trabalho, os desafios de sustentabilidade e impacto social que ela introduz e as estruturas éticas operacionais que devem traduzir princípios abstratos em controles concretos e auditoria contínua. A questão não é se a IA transformará as organizações e as pessoas, mas se seremos capazes de governar essa transformação com rigor, rapidez e responsabilidade.

Governança corporativa da IA

A IA transborda as estruturas tradicionais

Os modelos tradicionais de governança corporativa foram projetados para tecnologias previsíveis: sistemas que executam lógica determinística, operam dentro de limites definidos e se comportam de maneira reproduzível. A IA rompe todas essas premissas: ela toma decisões sem intervenção humana, produz resultados diferentes para a mesma entrada, opera por meio de processos internos opacos que seus próprios desenvolvedores não compreendem totalmente e depende de forma crítica de fornecedores externos cujos modelos evoluem sem controle organizacional direto.

As estruturas tradicionais de governança tecnológica são insuficientes. Os comitês de arquitetura e os ciclos anuais de aprovação são lentos demais para a velocidade da inovação da IA, não têm o expertise necessário para avaliar seus riscos específicos e não foram projetados para gerenciar a incerteza inerente aos sistemas que aprendem e mudam. A questão estratégica é como governar a IA sem diminuir a velocidade de adoção e acumular riscos incontroláveis.

Organização: funções e estruturas emergentes

As organizações estão criando funções executivas especializadas, embora com progresso heterogêneo. A figura do Chief AI Officer (CAIO), Chief Data and AI Officer (CDAIO) ou equivalente está surgindo, e estima-se que 26% das grandes organizações já tenham essa função. Em organizações mais maduras, o CDAIO se reporta diretamente ao CEO, com uma estrutura matricial muito forte em países e empresas; em outros, a liderança recai sobre o CTO/CIO ou o diretor de inovação.

Abaixo do nível executivo, estão surgindo funções especializadas que ainda não foram padronizadas: AI Risk Manager, AI Ethics Officer, AI Compliance Lead, Responsible AI Lead. Esses perfis geralmente se reportam a funções de segunda linha, mas suas responsabilidades, autoridade e recursos variam substancialmente entre as organizações.

A primeira linha consolida o Centro de Excelência em IA, equipes transversais que centralizam o conhecimento técnico (LLMs, arquiteturas multiagentes, frameworks), infraestrutura compartilhada (plataformas cloud, GPUs, licenças), emissão de diretrizes e padrões e consultoria interna para linhas de negócios. Operacionalmente, o modelo hub & spokes predomina: um Centro de Excelência central estabelece recursos transversais, enquanto as equipes descentralizadas nas linhas de negócios desenvolvem soluções específicas, reportando-se hierarquicamente aos seus superiores, mas com relatórios multifuncionais para o hub. Essa estrutura permite velocidades diferentes, dependendo da maturidade de cada linha, ao mesmo tempo em que mantém a coerência arquitetônica.

Na segunda linha, a maturidade organizacional é notavelmente menor. Enquanto a primeira linha tem estruturas consolidadas, a segunda linha apresenta alta variabilidade, e há um debate conceitual aberto sobre se o AI Risk constitui um risco autônomo na taxonomia corporativa ou um amplificador transversal dos riscos existentes. Pouquíssimas organizações o definem como um risco de primeiro nível (como uma decisão tática para garantir visibilidade e orçamento); mais frequentemente, ele aparece como um risco de segundo nível dentro do Risco de Modelo ou dos Riscos Não Financeiros. Outros se recusam a incluí-lo formalmente e tratam a IA como um amplificador transversal dos riscos existentes (maior risco de modelo, maior risco de fornecedor, risco de tecnologia com vulnerabilidades adicionais...), reforçando as estruturas existentes em vez de criar novas taxonomias.

Independentemente do debate taxonômico, surge uma pequena função de coordenação operacional, chamada AI Risk ou AI Governance, que orquestra as avaliações de risco por funções especializadas: o Risco de Modelo valida os modelos, o Risco de Tecnologia avalia a infraestrutura, a Segurança Cibernética analisa as vulnerabilidades específicas da IA, a Proteção de Dados verifica a privacidade, o Jurídico avalia a propriedade intelectual, o Compliance verifica o compliance regulatório etc.

Órgãos de governança: do comitê formal ao working group operacional

Praticamente todas as organizações sistêmicas criaram um Comitê de IA com uma composição de defesa de linha cruzada: primeira linha (inovação, analytics, dados, tecnologia...), segunda linha (risco de modelo, risco operacional, segurança cibernética, proteção de dados, vendor risk, jurídico, compliance...) e terceira linha (Auditoria como observadora). A copresidência geralmente cabe a um gerente de primeira e segunda linha.

No entanto, a governança não ocorre apenas no comitê. Por baixo, geralmente há uma estrutura informal, mas fundamental: um AI Working Group composto por aqueles que se reportam diretamente aos membros do comitê. Eles preparam materiais, concordam com posições e resolvem conflitos. As questões chegam ao comitê for information ou for approval, não para serem discutidas do zero. A verdadeira governança (negociação, consenso, resolução de tensões entre velocidade e controle) ocorre nessa camada pré-decisória, em que a primeira e a segunda linha criam acordos operacionais antes da sanção formal.

Arquitetura de frameworks de risco: backbone e uplifting setorial

As organizações não reinventam seus frameworks de risco do zero. Observa-se uma arquitetura de duas camadas: um backbone central específico de IA (uma política de IA sucinta, que estabeleça princípios, escopo, funções, classificação de riscos, processos de aprovação; e um procedimento de IA que descreva de forma abrangente o ciclo de vida, desde a concepção até a produção) e, acima de tudo, o uplifiting de frameworks específicos de IA existentes.

Os dados são convincentes: estima-se em que o ChatGPT atingirá aproximadamente 900 milhões de usuários ativos semanais até o final de 2025. Esse número coloca a IA generativa entre as tecnologias de adoção mais rápida da história, superando a taxa de penetração da Internet móvel, das redes sociais ou dos serviços de streaming.

Essa arquitetura aproveita a infraestrutura que funciona, atribui responsabilidades claras e mantém a consistência sem fragmentação. No entanto, alguns desafios técnicos são genuinamente novos. Explicar redes neurais profundas com transformadores e trilhões de parâmetros exige técnicas especializadas que não existiam na validação de modelos tradicionais. As funções de risco estão desenvolvendo esses recursos em tempo real.

Classificação de risco e ciclo de vida

O AI Act Europeu estabelece uma classificação (proibido, alto risco, risco limitado, risco mínimo), que é necessária, mas insuficiente para a governança corporativa das empresas. A regulação é projetada para proteger a sociedade e os direitos fundamentais, não as organizações contra seus próprios riscos operacionais, de reputação ou financeiros.

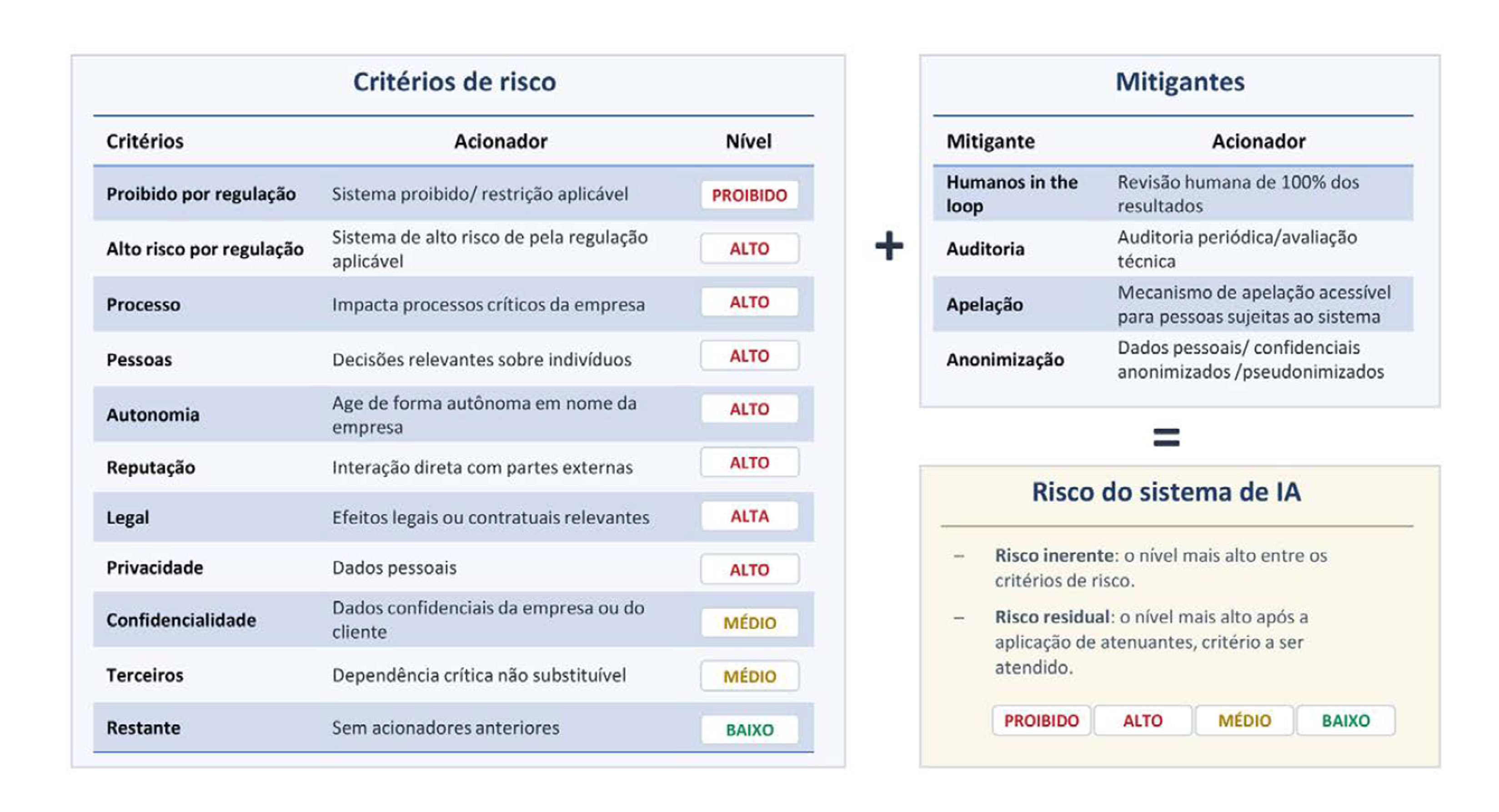

Portanto, as organizações estão convergindo para classificações internas de risco de IA mais exigentes, integrando critérios regulatórios aos seus próprios: impacto na reputação, criticidade do processo, classificação de segurança cibernética, tier do modelo de acordo com a validação, impacto financeiro direto, maturidade do fornecedor. Um sistema pode não ser de alto risco regulatório, mas pode ser de alto risco interno se afetar processos críticos ou gerar exposição massiva à reputação (Fig. 4).

A classificação determina as consequências operacionais. Por exemplo, o alto risco implica uma análise completa de todas as funções de risco, aprovação formal no comitê, documentação completa, validação independente, monitoramento intensivo etc.; enquanto o baixo risco geralmente implica um fast track, análise leve e o encaminhamento ao comitê apenas para informação. O fast-track é um elemento essencial, pois resolve a tensão entre velocidade e controle: obviamente, os sistemas de IA de baixo risco são aprovados sem demora, enquanto os recursos de controle são concentrados em sistemas de IA críticos.

Fig. 4. Exemplo de classificação interna de risco de uma empresa, além da regulação.

|

Inventário e rastreabilidade

As organizações são obrigadas pela regulação a manter um único registro de todos os sistemas de IA implantados, incluindo sua classificação de risco e status do ciclo de vida. Esse inventário deve ser completo, atualizado e acessível aos supervisores, auditores e funções de risco.

A maioria das organizações converge para a expansão do inventário de Risco de Modelo, sob a lógica de que os sistemas de IA exigem validação quando carregam um risco de modelo relevante. Como alternativa, algumas organizações expandem o inventário de ativos de tecnologia.

A governança corporativa da IA está amadurecendo em um ritmo acelerado. Nos próximos anos, haverá uma consolidação em direção às melhores práticas, mas a aceleração da evolução tecnológica é tal que provavelmente continuará a sobrecarregar as estruturas organizacionais atuais, que foram projetadas para paradigmas mais lentos.

Industrialização da IA (MLOps, LLMOps)

Da experimentação à produção

Atualmente, o principal gargalo na adoção real da IA não é algorítmico, mas operacional. Durante anos, organizações de todos os tipos desenvolveram sistemas de IA promissores em ambientes experimentais que nunca chegaram à produção ou que, uma vez implantados, falharam quando confrontados com dados reais, perderam desempenho ao longo do tempo ou geraram custos e riscos incontroláveis. A industrialização da IA surge justamente para fechar essa lacuna entre a experimentação e o uso sustentado em ambientes de produção.

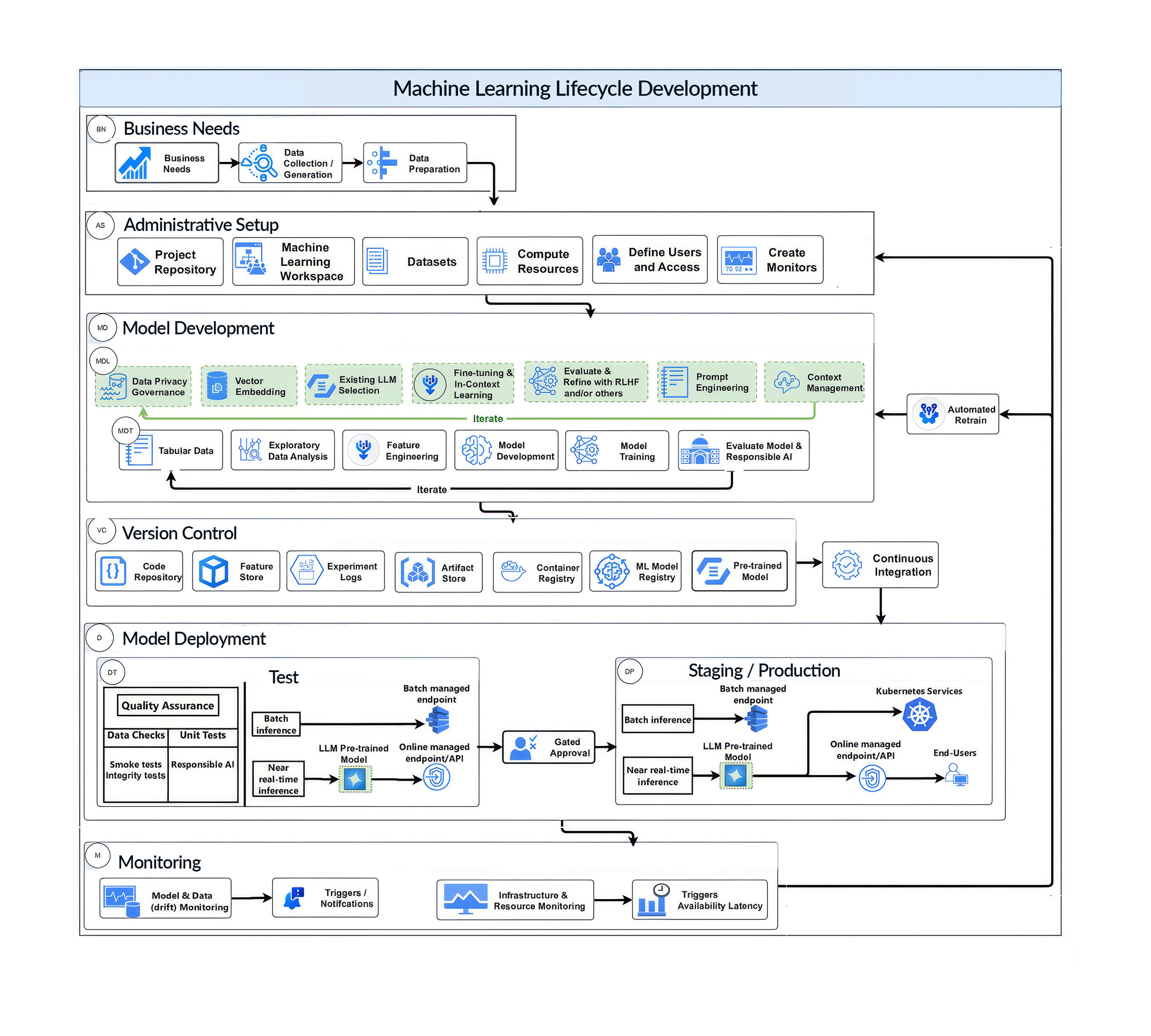

O Machine Learning Operations (MLOps) surge como uma resposta estruturada a esse problema. Ele pode ser entendido como ”um conjunto de processos padronizados e recursos tecnológicos para criar, implantar e operacionalizar sistemas de ML de forma rápida e confiável“. O MLOps articula processos e recursos técnicos para gerenciar a preparação de dados, a experimentação, o treinamento, a validação, a implantação, o monitoramento e o retreinamento contínuo de modelos de forma integrada. O objetivo não é apenas acelerar a produção, mas garantir a confiabilidade, a reprodutibilidade, o controle de riscos e a sustentabilidade operacional ao longo do tempo.

O advento da IA generativa amplia significativamente esse desafio. O Large Language Model Operations (LLMOps) não substitui o MLOps, mas o amplia para lidar com sistemas com propriedades radicalmente diferentes. Os modelos de linguagem de grande porte introduzem comportamento não determinístico, dependência crítica da formulação imediata, arquiteturas internas opacas com bilhões ou trilhões de parâmetros e novos vetores de risco, como alucinações, geração de conteúdo inverídico ou ataques direcionados por meio da manipulação de entrada. Essas complexidades são intensificadas em sistemas agênticos, em que uma única interação do usuário pode desencadear cadeias de raciocínio, várias chamadas de modelos internos e execução autônoma de ferramentas externas.

Arquitetura do ciclo de vida de MLOps/LLMOps

A industrialização eficaz da IA exige uma visão holística do ciclo de vida operacional, que diferentes autores expressam de diferentes maneiras (Fig. 5), mas com elementos comuns:

Na fase de preparação de dados, o MLOps se concentra na criação de pipelines robustos para ingestão, limpeza, transformação e controle de versão de dados estruturados, garantindo rastreabilidade e qualidade. O LLMOps amplia esse escopo ao trabalhar com grandes volumes de dados não estruturados (texto, código, documentos ou imagens) e representações vetoriais usadas em arquiteturas de retrieval-oriented generation (RAG). Isso está associado a requisitos rigorosos de minimização de dados pessoais, controle de origem e compliance com estruturas de privacidade, como o GDPR.

Durante a experimentação e o desenvolvimento, o MLOps fornece mecanismos para rastrear experimentos, comparar modelos, gerenciar hiperparâmetros e garantir a reprodutibilidade dos resultados. No LLMOps, essa fase incorpora novas dimensões: gerenciamento de prompts versionados, avaliação de diferentes configurações de modelos fundamentais, ajuste fino ou adaptação por meio de técnicas como LoRA e desenho de métricas que capturam aspectos qualitativos da geração, como consistência, factualidade, segurança ou adequação contextual. Essas métricas não substituem as métricas quantitativas tradicionais, mas as complementam quando o desempenho não pode mais ser medido apenas pela precisão ou pelo erro.

A validação é um dos principais pontos de divergência entre as duas abordagens. Enquanto no MLOps a validação se baseia em testes automatizados em conjuntos de dados de referência para avaliar a precisão, o viés e a robustez, no LLMOps é essencial integrar a validação humana ao ciclo. A avaliação de resultados generativos requer revisão por especialistas, técnicas de fact-checking em fontes confiáveis, testes de estresse semântico e exercícios de red-teaming projetados para identificar comportamentos indesejáveis ou vulnerabilidades exploráveis. A validação não é mais um evento isolado, mas um processo contínuo.

Na fase de implantação, o MLOps conta com pipelines de CI/CD relativamente maduros, com versões bem definidas de modelos e dependências. O LLMOps, por outro lado, deve lidar com implantações de modelos em grande escala com implicações significativas de infraestrutura, latência e custo. Isso inclui a seleção dinâmica de modelos com base no caso de uso, no nível de risco ou no orçamento, bem como a orquestração de sistemas complexos em que vários modelos e agentes interagem entre si de forma coordenada.

O monitoramento é fundamental em ambos os paradigmas, mas com ênfases diferentes. O MLOps concentra-se na detecção de drift de dados ou de conceitos, degradação do desempenho, erros e problemas de latência. O LLMOps acrescenta a necessidade de monitorar os custos por token em tempo real (um determinante importante da viabilidade econômica), identificar padrões de uso não previstos (prompt drift) e manter a rastreabilidade total das interações para análise forense, auditoria e supervisão regulatória. Sem essa visibilidade, os sistemas generativos podem aumentar rapidamente a complexidade e o custo sem um controle eficaz.

Por fim, a governança e o compliance regulatório abrangem todo o ciclo de vida. No MLOps, isso envolve a documentação da linhagem de dados e modelos, a definição de responsabilidades claras e a garantia de controles de qualidade. No LLMOps, esses requisitos são estendidos para responder às estruturas regulatórias emergentes, como o AI Act, incluindo inventários de sistemas classificados por nível de risco, mecanismos de supervisão humana e estratégias de explicabilidade adaptadas a modelos que funcionam como caixas pretas.

Fig. 5. Exemplo de fases de MLOps e LLMOps. Fonte: Stone (2025).

|

Integração com frameworks de governança

Os MLOps e LLMOps não são disciplinas puramente técnicas, nem podem operar isoladamente. Eles são a camada operacional que incorpora os princípios definidos em frameworks de governança mais amplas. O framework de gestão de riscos de IA do NIST estrutura a gestão de riscos de IA como um processo contínuo que abrange governança, contextualização, mensuração e gestão ao longo de todo o ciclo de vida do sistema. Complementarmente, a ISO/IEC 42001 define os requisitos de um sistema de gestão de IA, incluindo políticas, avaliações de impacto, controle de fornecedores e monitoramento contínuo.

Os processos automatizados de MLOps e LLMOps (pipelines de dados, validações sistemáticas, implementações controladas e monitoramento contínuo) são os mecanismos concretos que permitem que estes frameworks de governança passem da teoria à prática. Sem uma base operacional sólida, a governança de IA é reduzida a uma documentação aspiracional; sem frameworks de governança claros, a industrialização técnica carece de critérios de qualidade, responsabilidade e controle de riscos.

Portanto, a adoção madura da IA exige uma convergência real entre engenharia, operações e governança. A industrialização da IA não se trata apenas de modelos de escala, mas da criação de sistemas confiáveis, auditáveis e sustentáveis que possam ser integrados de forma responsável aos processos comerciais essenciais e à vida cotidiana das organizações. MLOps e LLMOps são frameworks de boas práticas em constante evolução, não soluções fechadas: se o problema de levar a IA à produção estivesse resolvido, não se observaria a persistência de modelos que se deterioram silenciosamente, geram custos imprevistos ou falham ao serem escalonados. Seu valor está em reduzir o atrito e estruturar a gestão de riscos, não em eliminá-los..Portanto, a adoção madura da IA exige uma convergência real entre engenharia, operações e governança. A industrialização da IA não se trata apenas de modelos de escala, mas da criação de sistemas confiáveis, auditáveis e sustentáveis que possam ser integrados de forma responsável aos processos comerciais essenciais e à vida cotidiana das organizações. MLOps e LLMOps são frameworks de boas práticas em constante evolução, não soluções fechadas: se o problema de levar a IA à produção estivesse resolvido, não se observaria a persistência de modelos que se deterioram silenciosamente, geram custos imprevistos ou falham ao serem escalonados. Seu valor está em reduzir o atrito e estruturar a gestão de riscos, não em eliminá-los..

Upskilling, reskilling e novas funções profissionais

O fator humano, o gargalo da IA

A proliferação da IA está transformando o trabalho de maneiras mais profundas do que sugerem as discussões focadas apenas na automação ou substituição de tarefas. O principal desafio para as organizações não é tecnológico, mas humano: ter as habilidades certas para desenhar, implantar, operar e governar sistemas de IA de forma sustentável. Nesse contexto, o talento não é mais entendido como um conjunto restrito de especialistas, mas como uma competência organizacional distribuída.

As conclusões desta seção são apoiadas por uma análise empírica abrangente realizada pela Management Solutions em um conjunto de 16 grandes organizações na Europa e nos EUA, com base em dados reais de mercado e evidências organizacionais.

Convergência em direção a um núcleo estável de funções de IA

À medida em que a IA amadurece, as organizações estão convergindo para um conjunto relativamente estável de competências e capacidades profissionais. Embora a nomenclatura varie entre os setores e as empresas, as funções desempenhadas por esses perfis estão se tornando homogêneas. No entanto, as funções formais são menos importantes do que as competências subjacentes: na prática, um mesmo profissional combina várias dessas competências, e as combinações mais incomuns (quem domina ao mesmo tempo LLMOps, regulação e prompt engineering, por exemplo) são precisamente as mais valiosas e escassas. Essa convergência reflete uma realidade operacional: o ciclo de vida da IA – dos dados à produção e ao controle – exige recursos diferenciados que não podem ser concentrados em um único tipo de profissional.

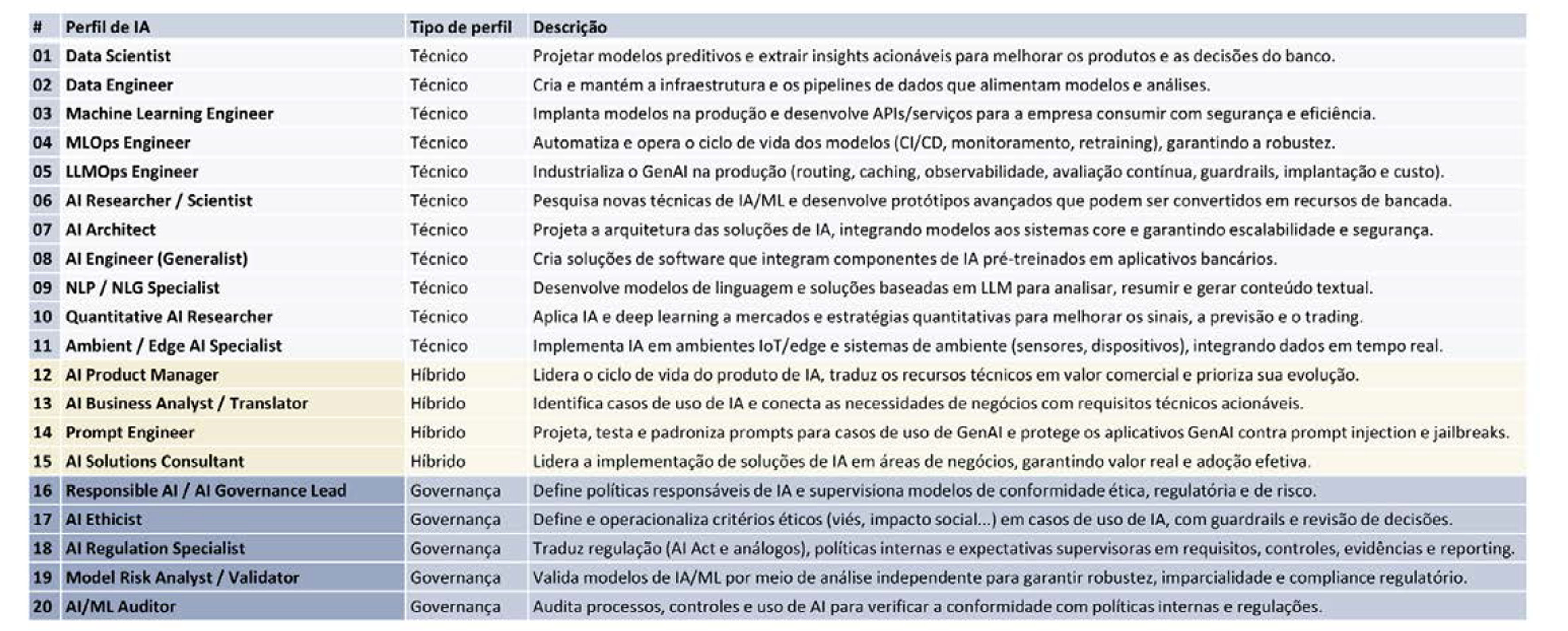

Em resumo, essas funções podem ser agrupadas em três blocos principais (Fig. 6). Primeiro, os perfis técnicos, responsáveis por desenhar modelos, construir infraestruturas de dados e levar soluções à produção. Em segundo lugar, os perfis híbridos, que conectam os recursos técnicos às necessidades de negócio e garantem que os sistemas de IA gerem valor real e sejam adotados. Por fim, os perfis de governança e controle, responsáveis pela gestão de riscos, compliance, auditoria e uso responsável da IA.

Essa estrutura de competências forma a espinha dorsal sobre a qual os recursos de IA das organizações são construídos, independentemente do setor em que operam.

Fig. 6: Perfis consolidados e emergentes de IA.

|

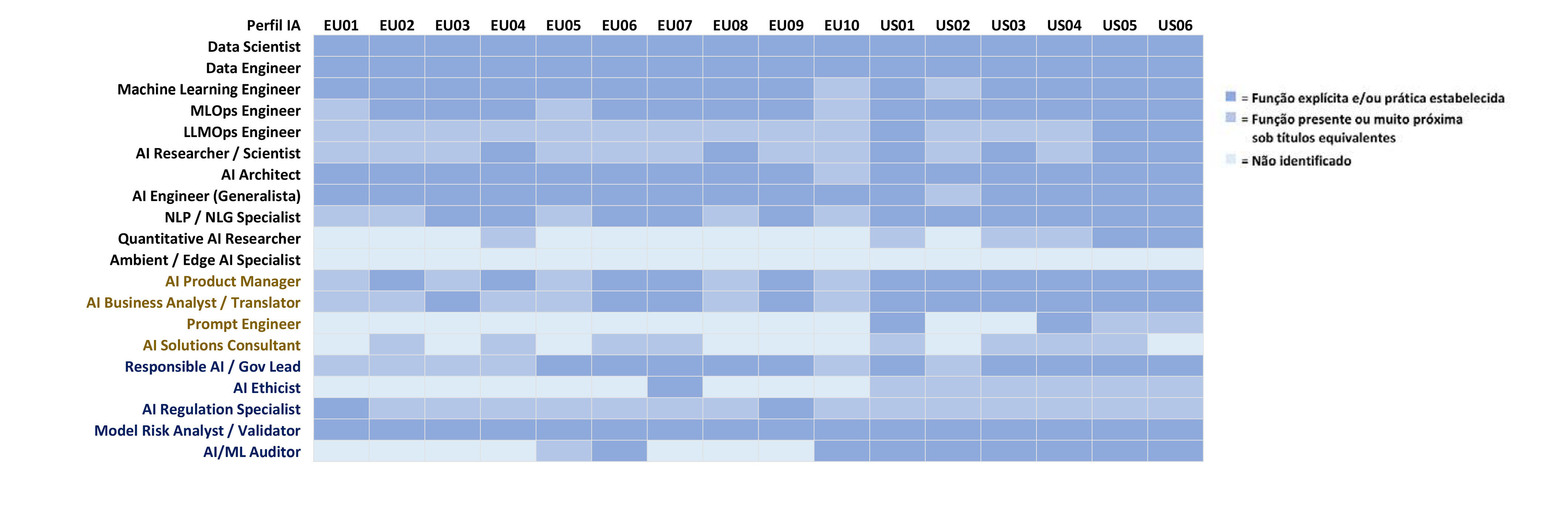

Maturidade desigual na adoção de funções especializadas

Embora o núcleo básico das funções de IA seja amplamente implantado em organizações avançadas (com heterogeneidade significativa), a adoção de perfis emergentes ou mais especializados é muito desigual em termos de maturidade. As diferenças não estão tanto na existência de recursos gerais, mas na institucionalização de funções avançadas relacionadas à operação de IA generativa e agêntica, à arquitetura de larga escala ou à governança específica desses sistemas.

Essa heterogeneidade é especialmente visível em funções emergentes ligadas a LLMOps, avaliação contínua de modelos generativos, segurança de prompts ou governança de IA. Em alguns casos, essas funções existem como papéis formais; em outros, elas são informalmente integradas a equipes mais tradicionais, com resultados mistos em termos de controle, escalabilidade e custo.

O mapa de calor (Fig. 7) ilustra que a diferença entre as organizações se manifesta em quais funções elas consolidaram e com que nível de especialização e autonomia.

Fig. 7. Mapa de calor da adoção de funções de IA.

|

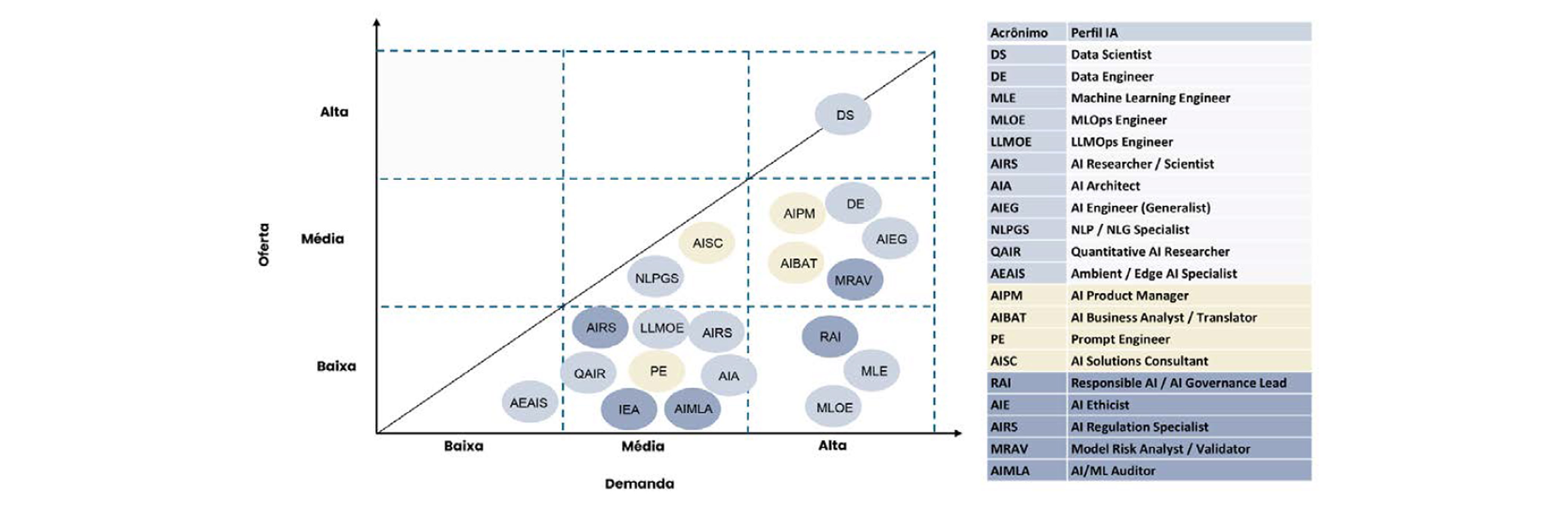

O verdadeiro gargalo: desequilíbrios entre oferta e demanda

A análise de oferta e demanda (Fig. 8) mostra um desequilíbrio estrutural generalizado no mercado de talentos de IA. A demanda é alta em praticamente todos os perfis analisados, enquanto a oferta é sistematicamente insuficiente para absorvê-la. Não se trata de uma escassez pontual ou concentrada, mas de um fenômeno transversal que afeta a maior parte do ecossistema profissional de IA.

A única exceção parcial é o perfil do cientista de dados, que está mais próximo de um equilíbrio relativo. Esse comportamento se deve à sua maior maturidade histórica, à existência de caminhos de treinamento consolidados e a um pool maior de profissionais com experiência acumulada. Entretanto, mesmo nesse caso, a pressão da demanda continua alta em cargos sênior ou especialistas.

No restante dos perfis, especialmente aqueles voltados para a produção (Machine Learning Engineering, MLOps, LLMOps) e funções de governança, risco e controle, o gap entre a demanda e a oferta é persistente. A combinação de complexidade técnica, requisitos de senioridade e aumento das exigências regulatórias limita a capacidade do mercado de gerar talentos no ritmo necessário. Como resultado, a terceirização, por si só, não permite fechar o gap, fazendo com que o upskilling e o reskilling internos sejam uma alavanca estrutural para escalar a IA com impacto e controle.

Fig. 8. Matriz de oferta e demanda de perfis de IA.

|

Implicações estratégicas

As implicações dessa análise são claras. A estratégia de talentos de IA não pode se basear exclusivamente na atração de perfis escassos no mercado. O aprimoramento e a requalificação internos tornam-se alavancas estratégicas, especialmente para funções críticas em que a oferta externa é estruturalmente insuficiente.

Da mesma forma, os perfis operacionais e de governança são tão decisivos quanto os perfis de modelagem ou pesquisa. A vantagem competitiva não está apenas no desenvolvimento de modelos avançados, mas na integração deles de forma segura, eficiente e compatível com os processos reais da organização.

Em última análise, a transformação impulsionada pela IA não é apenas tecnológica. É uma transformação do trabalho, das funções profissionais e das capacidades coletivas. As organizações que entenderem essa dimensão humana e a abordarem de forma estruturada estarão mais bem posicionadas para capturar o valor da IA de forma sustentável.

IA e transformação do setor (AI + X)

A IA como uma camada transversal

A IA deixou de ser uma tecnologia aplicada de forma incremental em setores específicos para se tornar uma camada transversal de inteligência que é integrada simultaneamente em vários domínios econômicos e sociais. Essa transição, amplamente documentada por organizações internacionais, é caracterizada por uma mudança de pilotos isolados para uma adoção estrutural que afeta processos inteiros, cadeias de valor e modelos operacionais. Nem todo o avanço segue uma lógica transversal: alguns dos desenvolvimentos mais significativos são impulsionados por setores específicos (IA médica, defesa ou serviços financeiros regulados), nos quais a especificidade do domínio, a natureza dos dados ou o marco regulatório geram capacidades que dificilmente podem ser transferidas para outros contextos sem uma adaptação substancial.

Em uma perspectiva comparativa, as evidências mostram que as diferenças entre os setores não são mais explicadas pela mera presença da IA, mas pela intensidade e profundidade de sua integração. A OCDE classifica os setores de acordo com sua AI Intensity com base em fatores como composição de tarefas, disponibilidade de dados e capital humano, mostrando que mesmo os setores tradicionalmente pouco digitalizados estão aumentando rapidamente sua exposição à IA. Essa adoção ocorre em paralelo entre os setores, gerando efeitos de aceleração cruzada e aprendizado intersetorial.

Em termos macroeconômicos e de emprego, o impacto é sistêmico. O Fundo Monetário Internacional estima que cerca de 40% do emprego global esteja exposto à IA, com porcentagens mais altas nas economias avançadas, onde a complementaridade entre IA e mão de obra qualificada é maior. A Organização Internacional do Trabalho qualifica que a IA generativa tende a automatizar tarefas específicas em vez de ocupações inteiras, reforçando a necessidade de adaptação organizacional e treinamento contínuo.

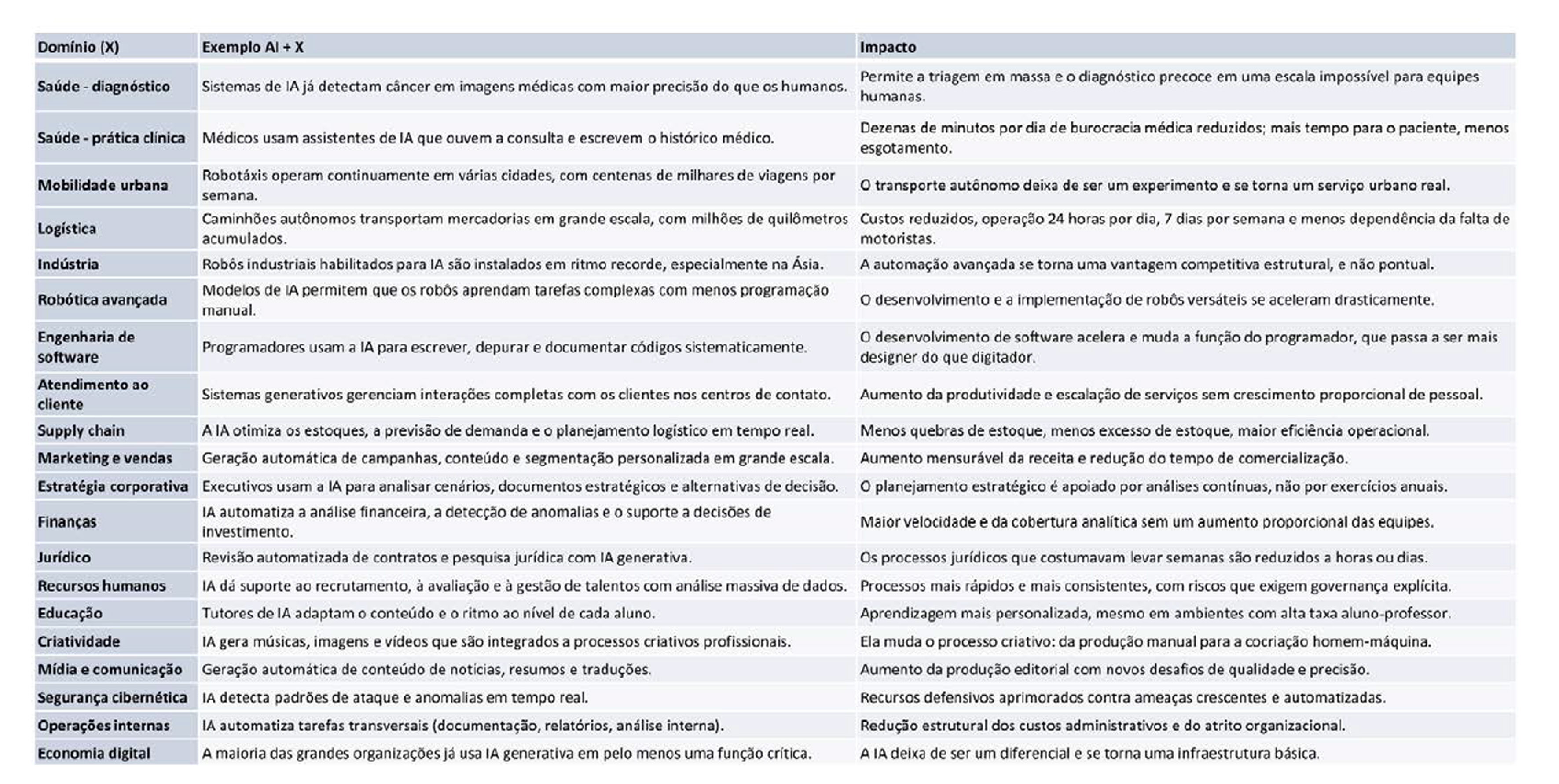

Nesse contexto, o conceito AI + X é útil para descrever um padrão estrutural: a IA é combinada com domínios setoriais específicos sem perder seu caráter de tecnologia de uso geral. Não se trata de uma soma de casos de uso independentes, mas de uma integração simultânea e transversal, apoiada por evidências empíricas recentes. Esta seção apresenta alguns exemplos ilustrativos, sem a pretensão de ser exaustiva (Fig. 9).

Saúde (AI + Health): precisão clínica e escalabilidade

Na área da saúde, a IA está sendo integrada a diagnósticos clínicos, suporte a decisões médicas, monitoramento de pacientes e automação administrativa. A Organização Mundial da Saúde documenta um crescimento constante no uso de sistemas de IA em radiologia, patologia e atenção primária, destacando tanto seu potencial clínico quanto os riscos associados.

Vários estudos demonstram que os sistemas de IA atingem níveis de precisão comparáveis ou superiores aos de especialistas humanos em tarefas como detecção de câncer em imagens médicas ou classificação dermatológica. Esses resultados não implicam em substituição direta, mas em uma expansão significativa da capacidade de diagnóstico e triagem em larga escala. Esse desenvolvimento, enfatiza a OMS, exige estruturas de governança sólidas, validação clínica e supervisão humana, devido ao seu impacto direto sobre as pessoas.

Educação (AI + Education): personalização em escala

Na educação, a IA generativa está transformando a criação de conteúdo, a avaliação e o suporte ao aprendizado. A UNESCO identifica o uso crescente de tutores adaptativos, a geração automática de materiais de aprendizagem e os sistemas de avaliação formativa contínua como tendo o potencial de melhorar a personalização e reduzir as gaps educacionais.

A Educação é um dos setores em que a IA pode ter impactos estruturais no médio prazo, permitindo modelos de aprendizagem mais flexíveis e adaptáveis. No entanto, esses benefícios dependem fundamentalmente de políticas públicas e estruturas institucionais que preservem a equidade, a integridade acadêmica e o papel dos professores.

Trabalho e emprego (AI + Work): reconfiguração de tarefas

A IA está redefinindo o trabalho de forma transversal, afetando as ocupações em praticamente todos os setores. O FMI estima que a exposição à IA é responsável por cerca de 60% do emprego nas economias avançadas, em comparação com porcentagens menores nas economias emergentes, refletindo as diferenças na estrutura de produção e no capital humano.

A OIT, por sua vez, conclui que a IA generativa tem, por enquanto, um impacto maior em tarefas cognitivas específicas do que em empregos inteiros, o que implica uma reconfiguração do conteúdo do emprego em vez de uma substituição massiva. Essa evidência reforça a necessidade de estratégias de aprimoramento e requalificação, conforme discutido acima.

Indústria e operações (AI + Industry): produtividade e eficiência

Em ambientes industriais e operacionais, a IA é aplicada à manutenção preditiva, à otimização de processos, ao planejamento e à robótica avançada. Muitas organizações já passaram de testes-piloto para implantações em escala total, integrando a IA a processos críticos de produção e logística.

Já existem fortes evidências de melhorias significativas de eficiência e redução de falhas em sistemas industriais em que a IA é sistematicamente integrada, embora os maiores benefícios sejam observados quando a tecnologia é acompanhada por mudanças organizacionais e de processo.

Finanças e serviços intensivos em informação (AI + Finance)

Em setores com uso intensivo de informações, como finanças e serviços profissionais, a IA é usada para detecção de fraudes, gestão de riscos, personalização de serviços e automação de documentos. Uma expansão constante do uso da IA nessas áreas é observada, com diferenças relevantes dependendo da estrutura regulatória e da capacidade organizacional.

A adoção da IA generativa nesses setores está associada a melhorias de produtividade e ao surgimento de novos modelos de serviços, embora seja observado que os benefícios dependem da qualidade dos dados, da governança e da integração aos processos existentes.

Criatividade e conteúdo (AI + Criative): novos modelos culturais

A geração de texto, imagem, música e vídeo orientada por IA está transformando os setores criativos e de mídia. Vemos um crescimento acelerado desses aplicativos e um aumento significativo em seu uso comercial e cultural nos últimos anos.

Esse desenvolvimento levanta debates regulatórios e econômicos relevantes, especialmente em relação à propriedade intelectual e aos modelos de negócios, que estão sendo abordados de forma desigual por diferentes estruturas regulatórias.

Síntese: de setores à infraestrutura transversal

Além dos exemplos setoriais, as evidências convergem para um ponto central: a transformação atual não está na adoção isolada da IA em setores específicos, mas em sua integração simultânea e transversal como infraestrutura operacional e cognitiva. Os estudos concordam que a vantagem competitiva não é mais obtida com a aplicação da IA a funções individuais, mas com sua integração coerente ao longo de toda a cadeia de valor.

Nesse sentido, a AI+X não descreve mais um modismo terminológico, mas um padrão estrutural de transformação. Compreender essa lógica é essencial para prever os impactos setoriais, elaborar políticas públicas adequadas e definir estratégias organizacionais capazes de capturar o valor da IA de forma sustentável.

Fig. 9. Exemplos representativos de AI + X, priorizando casos em que a IA passou do piloto para o uso operacional mensurável. Fonte: adaptado de Stanford (2025)..

|

IA na vida pessoal e cotidiana

A mudança de paradigma: pessoas em primeiro lugar, organizações em segundo

A IA generativa foi uma inversão radical do paradigma tecnológico tradicional. Ao contrário das tecnologias empresariais anteriores (cloud computing, ERP, CRM), que nasceram em ambientes corporativos e foram gradualmente transpostas para o consumo pessoal, a IA generativa entrou primeiro na vida cotidiana das pessoas e só depois foi formalmente adotada pelas organizações.

Os dados são convincentes: estima-se em que o ChatGPT atingirá aproximadamente 900 milhões de usuários ativos semanais até o final de 2025. Esse número coloca a IA generativa entre as tecnologias de adoção mais rápida da história, superando a taxa de penetração da Internet móvel, das redes sociais ou dos serviços de streaming.

Mais revelador ainda é o fato de que a proporção de uso pessoal não apenas precede, mas também excede consistentemente o uso profissional. Na União Europeia, 25,1% da população usa ferramentas de IA generativas para fins pessoais, em comparação com 15,1% em contextos de trabalho e apenas 9,4% na educação formal. Nos países da OCDE, mais de um terço das pessoas relatam o uso regular de IA generativa, sendo que os estudantes lideram a adoção: três quartos dos estudantes com mais de 16 anos usam essas ferramentas, enquanto 41,1% dos funcionários as integram em seu trabalho, muitas vezes informalmente, mesmo antes de suas organizações autorizarem.

Essa sequência temporal não é anedótica: ela redefine a lógica da transformação digital. As organizações não estão liderando a adoção da IA; elas estão respondendo a recursos que seus funcionários, clientes e fornecedores já possuem e usam de forma não oficial.

O fenômeno da IA invisível (uso não autorizado de ferramentas de IA em ambientes corporativos) não é uma anomalia transitória, mas uma consequência estrutural desse investimento: as pessoas adquiriram habilidades cognitivas ampliadas em suas vidas pessoais que, em seguida, transferiram espontaneamente para seus empregos, criando exposições a riscos que a maioria das empresas ainda não controla.

Magnitude, distribuição e fraturas: quem usa IA e com que finalidade

A adoção da IA na vida pessoal abrange um amplo espectro de atividades. Os usos dominantes incluem criação de conteúdo (texto, imagens, música, vídeo), suporte para aprendizado e exploração conceitual, automação de tarefas rotineiras, companhia para conversas e acesso a informações: nos EUA, 10% dos adultos usam chatbots de IA para obter notícias, introduzindo um novo vetor de mediação de informações com profundas implicações para o debate público.

Entretanto, essa democratização é radicalmente assimétrica. As divisões geográficas são extremas: na Noruega, 56% da população usa ferramentas de IA generativas; na Dinamarca, 48,4%; na Estônia, 46,6%. Em contrapartida, na Turquia, o número cai para 17%; na Romênia, 17,8%. Mesmo dentro das economias desenvolvidas, as diferenças são substanciais: a Alemanha está em 32%, a França em 37%, a Espanha em 38%, enquanto a Itália permanece abaixo de 20%.

A diferença de gerações é ainda mais acentuada. A diferença na adoção entre os grupos etários mais jovens e mais velhos chega a 53,6 pontos percentuais, o que a torna o fator de segmentação mais decisivo, à frente da educação (diferença de 21 pontos percentuais) ou do nível de renda (21 pontos). Enquanto 75% dos estudantes usam IA generativa regularmente, apenas 12,5% dos aposentados ou pessoas economicamente inativas relatam tê-la usado. A diferença de gênero, por outro lado, é comparativamente menor: 4,2 pontos percentuais.

O paradoxo da adoção em massa

Globalmente, 66% da população acredita que os produtos e serviços baseados em IA terão um impacto significativo em suas vidas diárias nos próximos três a cinco anos, um aumento de seis pontos percentuais desde 2022. No entanto, esse reconhecimento do impacto iminente coexiste com uma ambivalência crescente.

O público em geral demonstra um alto nível de preocupação: nos EUA, 51% dos adultos dizem que estão mais preocupados do que animados com o aumento do uso da IA na vida cotidiana, em comparação com apenas 11% que expressam maior entusiasmo. Entre os especialistas em IA, a proporção é inversa: 47% estão mais animados do que preocupados e apenas 15% mais preocupados. Essa divergência de 40 pontos percentuais entre os especialistas e o público reflete não apenas diferenças no conhecimento técnico, mas também percepções estruturalmente diferentes da relação risco-benefício.

A familiaridade com a IA não leva automaticamente à confiança. Embora o uso pessoal se correlacione positivamente com as percepções da IA como uma oportunidade, ele também aumenta a conscientização de seus riscos. A confiança de que as empresas de IA protegem adequadamente os dados pessoais varia de 50% em 2023 a 47% em 2024. Ao mesmo tempo, diminuiu a proporção de pessoas que acreditam que os sistemas de IA são imparciais e livres de discriminação.

O contexto de uso é absolutamente fundamental. Pesquisas no Reino Unido mostram oscilações de até 110 pontos percentuais na aceitação pública, dependendo do caso de uso específico: de um saldo líquido de +53% de conforto com o uso da IA para analisar dados de tráfego em tempo real e melhorar os fluxos rodoviários, a um saldo de -57% contra o uso da IA para analisar preferências políticas e direcionar publicidade personalizada.

Há, no entanto, um consenso transversal entre os especialistas e o público em geral: ambos os grupos querem mais controle sobre como a IA é usada em suas vidas (55% do público e 57% dos especialistas), e ambos acham que não têm esse controle atualmente (menos de 25% em ambos os casos). Este gap entre a demanda por atuação e a percepção de impotência constitui um dos desafios mais urgentes para a governança democrática da IA.

Desigualdade de acesso e risco de exclusão

A assimetria na adoção da IA na vida pessoal não é uma exclusão digital convencional. Não se trata apenas de uma questão de acesso à infraestrutura tecnológica (conexão à Internet, dispositivos), mas de acesso diferenciado a uma maior capacidade intelectual. Aqueles que integram a IA como uma ferramenta cognitiva cotidiana obtêm vantagens cumulativas em termos de aprendizado, produtividade, criatividade e acesso à informação. Aqueles que não o fazem enfrentam um atraso estrutural crescente.

Os grupos desconectados digitalmente percebem a IA de forma marcadamente negativa: 51% preveem um impacto pessoal negativo, em comparação com apenas 17% que esperam benefícios. Essa percepção não é irracional: ela reflete a intuição de que a transformação em andamento pode redistribuir as oportunidades de forma profundamente desigual.

A IA já está transformando a vida diária de aproximadamente um bilhão de pessoas. A questão estratégica não é mais se essa transformação continuará, mas se as sociedades criarão estruturas que transformem a IA em uma infraestrutura pública inclusiva ou se permitirão que ela se enraíze como um vetor de fragmentação social irreversível.

IA, sustentabilidade e impacto social

A sustentabilidade entra na era algorítmica

A transição sustentável não é mais uma questão exclusiva de infraestruturas físicas (novas usinas renováveis, redes de eletricidade, eletrificação do transporte), mas também um desafio de coordenação sistêmica. Os sistemas de energia atuais combinam geração distribuída, intermitência renovável, armazenamento, mercados dinâmicos e demanda flexível. Essa complexidade não pode ser gerenciada apenas por regras estáticas ou planejamento linear.

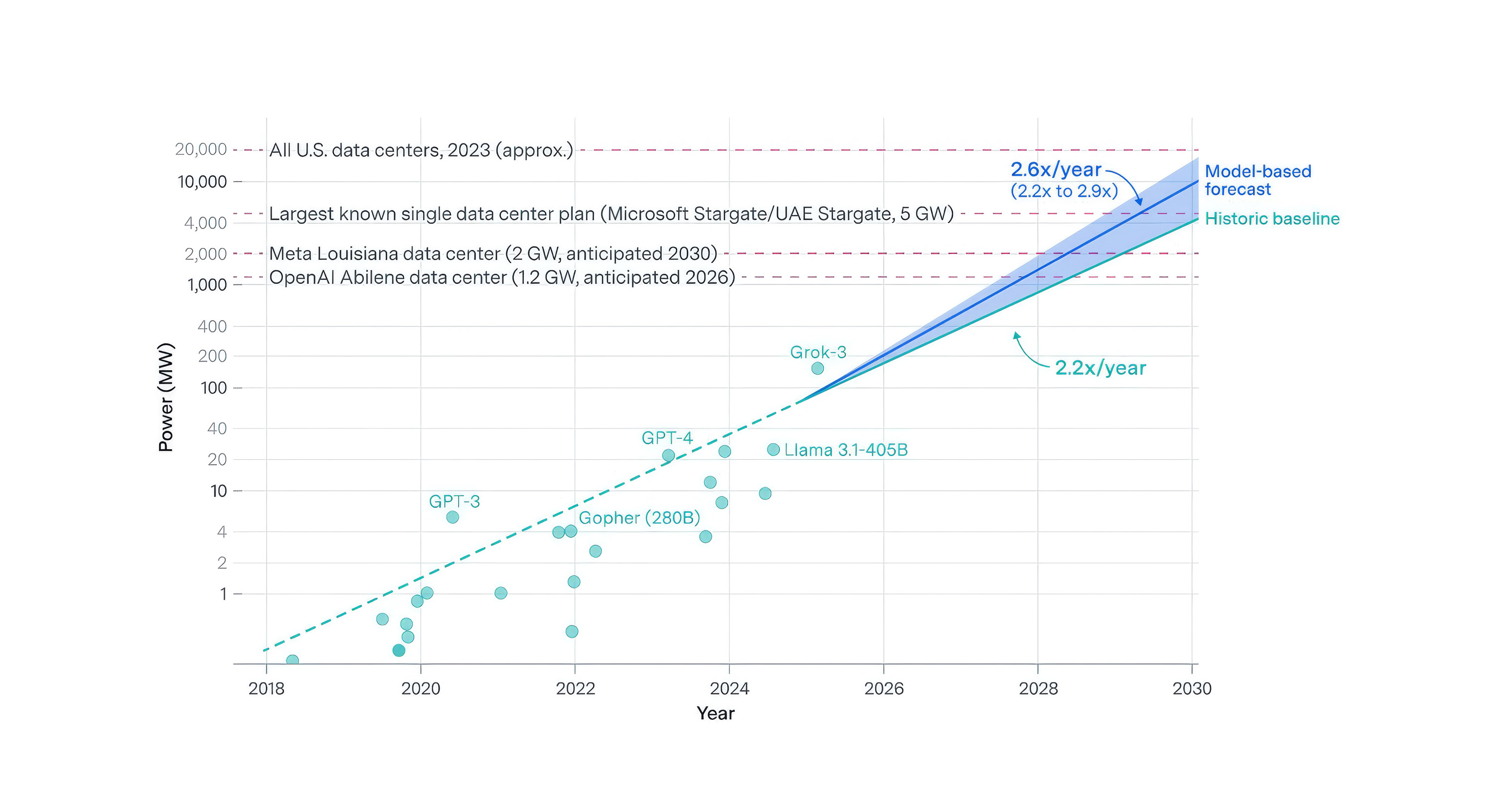

Nesse contexto, a IA surge como uma infraestrutura cognitiva capaz de modelar interdependências, simular cenários e otimizar decisões em tempo real. A eletrificação acelerada e o crescimento estrutural da demanda de eletricidade estão remodelando a capacidade, a flexibilidade e as necessidades de planejamento da rede nos próximos anos: em 2024, os data centers consumiram 1,5% da eletricidade global, a energia necessária para treinar modelos de fronteira está crescendo a uma taxa de 2,2x a 2,9x por ano (Fig. 10), e as maiores execuções já excedem 100 MW de energia instantânea. Portanto, a sustentabilidade está entrando em uma fase em que a capacidade computacional se torna parte integrante da arquitetura de energia e clima.

A mudança é conceitual: de decisões baseadas em médias históricas para decisões baseadas em simulações dinâmicas e análises probabilísticas de alta resolução. A IA não substitui a engenharia e a física, mas amplia a capacidade de antecipação e coordenação em sistemas com múltiplas variáveis e restrições simultâneas.

Fig. 10. Crescimento da demanda de energia da IA de fronteira. Fonte: Epoch (2025b).

|

Otimização do planeta: eficiência, resiliência e adaptação

Em termos operacionais, a IA está agindo como um acelerador da transição. Nas redes de eletricidade, os modelos preditivos permitem antecipar picos de demanda, otimizar o envio, reduzir o congestionamento e melhorar a integração de energias renováveis variáveis. Sem a IA, a integração ideal das energias renováveis e o gerenciamento em tempo real seriam mais incertos. Em um ambiente em que a eletricidade assume um papel central na descarbonização, a eficiência operacional deixa de ser marginal e se torna uma condição estrutural.

A relação entre energia e IA também é bidirecional: embora a IA possa melhorar significativamente a eficiência energética, o planejamento da rede e o gerenciamento de sistemas complexos e reduzir as emissões da ordem de 1.400 Mt CO2eq por ano até 2035 em cenários de ampla adoção, No entanto, este potencial de redução coexiste com um aumento estrutural do consumo energético da própria infraestrutura de IA que, na ausência de uma transição paralela para energias limpas, pode resultar em um saldo líquido neutro ou negativo em termos de emissões. A questão estrategicamente relevante não é se a IA pode contribuir para a descarbonização —ela pode—, mas sob quais condições energéticas e de governança este potencial se materializa sem ser consumido por sua própria pegada infraestrutural.

Além do sistema elétrico, a IA melhora a resiliência a riscos físicos crescentes. A modelagem climática apoiada no machine learning aumenta a granularidade espacial e temporal das previsões, facilitando as decisões em planejamento urbano, seguros e infraestrutura essencial. Na agricultura e no gerenciamento de água, a otimização orientada por dados reduz o desperdício e ajusta os insumos de acordo com as restrições ambientais.

Esses desenvolvimentos estão inseridos em uma agenda global mais ampla. O progresso em direção aos Objetivos de Desenvolvimento Sustentável está progredindo em um cenário de estresse energético, climático e demográfico. Nesse cenário, a IA pode atuar como um catalisador transversal: não como um substituto para as políticas públicas, mas como uma ferramenta que melhora a eficiência, reduz os atritos e permite alocações mais precisas de recursos escassos.

O custo oculto: energia, materiais e concentração de infraestrutura

A própria infraestrutura digital que possibilita essas melhorias gera novas pressões. O crescimento dos data centers e das cargas computacionais associadas à IA está contribuindo para o aumento da demanda de eletricidade em algumas economias avançadas:

- A AIE projeta que o consumo global de eletricidade dos data centers se multiplicará até 2030, atingindo 945 TWh/ano, o equivalente ao consumo de eletricidade do Japão atualmente, sendo a IA o principal impulsionador dessa expansão

- As maiores execuções individuais de treinamento de modelos de fronteira podem exigir de 4 a 16 GW de energia até 2030, o equivalente à geração de várias usinas nucleares e ao consumo de eletricidade de milhões de residências

- The power required to train frontier models has been growing by more than 2x per year, driven by compute growth of 4-5x per year, partially offset by hardware energy efficiency improvements (ca. 40% per year on leading GPUs).

Portanto, a implantação massiva de modelos avançados pode se tornar um impulsionador estrutural do crescimento do consumo de energia se não for acompanhada por melhorias de eficiência e planejamento energético.

A sustentabilidade da IA não pode ser avaliada apenas pelos benefícios que produz, mas também pelos recursos que consome: em cenários de linha de base, as emissões de CO2 da eletricidade do data center podem chegar a 300-320 Mt de CO2 por ano até 2030 se a eletricidade adicional continuar a depender muito de combustíveis fósseis. O treinamento e a implantação de modelos em larga escala requerem energia, água para resfriamento (em algumas regiões, em concorrência direta com o uso agrícola ou doméstico) e hardware com uso intensivo de materiais críticos. Além disso, a localização geográfica dos data centers introduz assimetrias: a intensidade de carbono da eletricidade varia substancialmente entre as regiões, o que implica pegadas ambientais diferenciadas para o mesmo serviço digital.

Essa dimensão de infraestrutura acrescenta uma camada geopolítica. A concentração da capacidade de computação em determinados países ou regiões reconfigura as dependências estratégicas e o acesso à tecnologia. A IA não é apenas uma ferramenta ambiental; ela também é um nó crítico no mapa global de energia e tecnologia.

A questão não é se a IA "compensa" sua pegada, mas como ela é projetada e implantada para maximizar a eficiência energética por unidade de capacidade cognitiva gerada. A sustentabilidade da IA torna-se, portanto, uma questão de arquitetura e de governança.

Sustentabilidade sem inclusão não é sustentável

A dimensão ambiental não esgota a análise. Deve-se fazer uma distinção entre a transição energética socialmente justa (ligada à mudança no modelo de produção e energia) e a transição justa associada à implantação da própria IA. Essa última introduz efeitos distributivos específicos. A capacidade de integrar tecnologias avançadas depende do capital humano, da infraestrutura digital e da qualidade institucional. As economias mais intensivas em tecnologia tendem a capturar os ganhos de produtividade e eficiência mais cedo, o que pode aumentar as diferenças com as regiões menos preparadas.

Do ponto de vista do desenvolvimento humano, a tecnologia pode expandir as capacidades (educação, acesso a serviços, participação econômica) ou consolidar as exclusões existentes, dependendo do contexto de adoção e do grau de democratização do acesso às suas ferramentas. A ampliação de capacidades digitais em PMEs, empresários e grupos com menos capital tecnológico constitui um mecanismo importante para dar suporte tanto à criação quanto ao ajuste. Na esfera do trabalho, a convergência entre a transição verde e a automação inteligente pode acelerar os processos de realocação setorial e transformação de habilidades, com uma sequência de tempo em que os efeitos de deslocamento podem preceder a criação de novas oportunidades. O gerenciamento desse intervalo de tempo exige planejamento estratégico, políticas ativas de qualificação e mecanismos para facilitar a ampla disseminação dos ganhos de produtividade.

De uma perspectiva estrutural, a sustentabilidade ambiental exige uma transição energética socialmente justa que evite a concentração dos custos da mudança em determinados territórios, setores ou grupos. Esse desafio é conceitualmente independente do uso da IA. Paralelamente, a implantação da IA apresenta sua própria transição justa: os ganhos de produtividade e eficiência tendem a se materializar de forma desigual e com uma defasagem de tempo em relação aos impactos negativos iniciais, especialmente no emprego e em determinadas habilidades. Portanto, a IA aplicada à sustentabilidade deve ser avaliada não apenas em termos de seu impacto agregado, mas também em termos da distribuição efetiva de seus benefícios e das estratégias públicas e privadas para ampliar o acesso e atenuar os custos sociais do ajuste.

IA sustentável by design: da ambição à disciplina

A convergência dessas dimensões – otimização sistêmica, pressão infraestrutural e efeitos distributivos – força o debate a mudar de princípios gerais para práticas verificáveis. A IA alinhada às metas de sustentabilidade exige métricas explícitas sobre o consumo de energia e as emissões associadas, transparência na arquitetura e no local de implantação e avaliação dos impactos sociais nas decisões automatizadas.

A estrutura dos ODS reforça essa necessidade de coerência estrutural entre tecnologia e desenvolvimento sustentável. Por sua vez, a inter-relação entre energia e digitalização exige a integração de variáveis energéticas no planejamento tecnológico corporativo e público.

Em suma, a IA ocupa uma posição ambivalente na transição sustentável: ela pode possibilitar reduções de emissões da ordem de gigatoneladas, mas o treinamento de seus modelos mais avançados pode atingir escalas de 4 a 16 GW por execução individual até 2030, colocando a IA na mesma escala de energia das grandes infraestruturas industriais.

A IA é simultaneamente um acelerador da eficiência sistêmica, um novo ônus de infraestrutura e uma força distributiva com efeitos sociais diferenciados. A questão não é se a IA fará parte da transição sustentável, mas sob quais condições de energia e distribuição.

Ética e filosofia da IA

Um problema em aberto após mais de 200 frameworks

A OIT catalogou 245 frameworks, códigos e recomendações de ética de IA emitidos desde 2017 por governos, agências internacionais, empresas e sociedade civil; uma meta-análise acadêmica anterior identificou pelo menos 17 princípios recorrentes em 200 deles: transparência, justiça, responsabilidade, privacidade, há um consenso regulatório subjacente. E, no entanto, os problemas éticos associados à IA não diminuíram com a proliferação destes frameworks, mas aumentaram em complexidade, e surgiram questões para as quais nenhum deles oferecia categorias anteriores.

O gap entre a formulação de princípios e sua tradução em decisões concretas não é um problema técnico a ser resolvido: é o problema central da governança da IA.

Do princípio à ação: operacionalizando a ética da IA

O gap entre um documento de valores e o comportamento real de um sistema de IA é onde reside o risco operacional. Esse fenômeno, conhecido como ethics washing, nem sempre é deliberado: ele geralmente reflete a dificuldade genuína de traduzir um princípio abstrato ("o sistema deve ser justo") em um critério de design, um procedimento de auditoria ou uma linha organizacional de responsabilidade. Para resolver este gap, é necessário transformar a abordagem da ética de declarativa para operacional.

Um modelo de operacionalização bem documentado e amplamente citado no setor financeiro é o De Volksbank, um banco holandês cuja governança ética de IA foi analisada em detalhes. Sua estrutura inclui uma área de Ética de IA incorporada à função de Compliance, com perfis filosóficos e técnicos, que avalia cada sistema de IA individualmente antes da implantação: análise de impacto ético, triagem de viés, rastreabilidade de decisões e canais de escalonamento formalizados. O caso ilustra que a operacionalização eficaz não está no escopo dos princípios declarados, mas na robustez dos processos, funções e pontos de decisão que os concretizam.

Resumindo o estado da arte, uma estrutura operacional de ética de IA em uma grande organização normalmente incorpora seis componentes:

1. Estrutura de governança: definição de quem decide, quem revisa e quais linhas de defesa existem, com documentação explícita das responsabilidades.

2. Avaliação do impacto no sistema: análise específica para cada caso de uso, proporcional ao nível de autonomia do sistema e às consequências das decisões delegadas a ele.

3. Gestão contínua de vieses: mecanismos de detecção e correção que operam de forma contínua, não como auditorias pontuais.

4. Transparência e explicabilidade diferenciada por público: os requisitos de informação do órgão regulador, do cliente e do funcionário afetado por uma decisão automatizada são substancialmente diferentes.

5. Mecanismos de escalação e comunicação: canais acessíveis e protegidos para comunicar comportamentos inesperados do sistema.

6. Revisão periódica do próprio framework: as atualizações dos modelos podem alterar o perfil de risco dos usos já implementados, exigindo reavaliação contínua, não apenas no momento da implementação inicial.

Um benchmark de operacionalização recente atua em um nível mais profundo: não na camada de implantação organizacional, mas no treinamento do próprio modelo. A Constitution publicada pela Anthropic em janeiro de 2026 é o primeiro documento público de um laboratório de fronteira a codificar valores diretamente no processo de treinamento, com uma hierarquia explícita e fundamentada entre segurança, ética, compliance e utilidade. A mudança conceitual subjacente é significativa: em vez de impor regras de comportamento de fora, o sistema pretende internalizar o raciocínio por trás de cada princípio, de modo que possa generalizar esse julgamento para situações imprevistas.

A mudança da função ética para a operacionalização enfrenta, no entanto, um limite conceitual que os frameworks atuais não resolvem: eles pressupõem implicitamente que há clareza sobre o tipo de instituição que está sendo governada.

O que estamos criando? A pergunta que as estruturas não respondem

As estruturas regulatórias existentes, incluindo o AI Act da UE, classificam os sistemas de IA por nível de risco e domínio de aplicação. Essa classificação é operacionalmente útil e oferece alguma cobertura ética (no sentido de proteger contra possíveis abusos da IA), mas não faz distinção entre os diferentes tipos de relacionamento que um sistema estabelece com os seres humanos. Um sistema de scoring de crédito, um assistente de conversação e um agente autônomo que negocia contratos em nome de uma organização podem se sobrepor em sua categoria de risco regulatório e, ainda assim, operar em bases éticas fundamentalmente diferentes. Um sistema que adapta seu comportamento ao interlocutor, mantém a consistência ao longo do tempo e produz respostas contextualmente indistinguíveis das de uma pessoa com compreensão genuína levanta questões que o compliance regulatório convencional não foi projetado para absorver.

Essas questões são de quatro tipos, todas acionáveis para as organizações que estão implantando sistemas de IA:

- Ontologia: que tipo de instituição é esse sistema e quais categorias são relevantes para descrevê-lo e governá-lo?

- Epistemologia: que tipo de instituição é esse sistema e quais categorias são relevantes para descrevê-lo e governá-lo?

- Teoria da mente: como o sistema verifica o que afirma e como os humanos podem validar a confiabilidade do que ele produz?

- Ética aplicada:existe algum tipo de experiência interna associada à operação do sistema (por mais rudimentar que seja) e que implicações isso tem para aqueles que o projetam e implantam?

Essas não são perguntas especulativas. Em janeiro de 2026, a Anthropic reconheceu publicamente que seu modelo Claude "pode possuir alguma forma de consciência ou status moral", tornando-se o primeiro laboratório de fronteira a tornar pública essa afirmação. A importância desse reconhecimento não está apenas no que ele diz, mas no que ele revela: que uma empresa de classe mundial admite que não pode responder com certeza à pergunta sobre o que ela criou.

Todas as decisões sobre como usar, auditar e regular um sistema de IA incorporam implicitamente uma resposta a essa pergunta. Na maioria das organizações, essa resposta ocorre por padrão, sem deliberação explícita.

Quatro fraturas: perguntas sem resposta

A expansão da IA não apenas amplia os dilemas éticos conhecidos: ela gera fraturas conceituais para as quais as estruturas legais e éticas atuais não têm uma resposta estruturada.

A primeira é a crise epistêmica da verificação. O AlphaFold previu a estrutura de mais de 200 milhões de proteínas, e mais de três milhões de pesquisadores em 190 países as utilizam como base de seu trabalho. Uma proporção significativa dessas estruturas não pode ser verificada experimentalmente com métodos científicos convencionais, mas elas são usadas para projetar medicamentos e orientar decisões clínicas. A questão subjacente não é se o sistema funciona (ele o faz com um nível de precisão sem precedentes), mas quais protocolos éticos e regulatórios correspondem a um cenário em que o conhecimento cientificamente operacional se torna computacionalmente inacessível à verificação humana.

A segunda é a assimetria de responsabilidade em danos emergentes. As estruturas éticas e jurídicas herdadas pressupõem atores identificáveis com intenções discerníveis. Os sistemas de IA causam danos sem intenção deliberada direta e com a causalidade distribuída entre vários atores (projetistas, treinadores, implantadores e usuários), configurando o que a literatura chama de "many hands problem": situações em que a responsabilidade moral e legal é estruturalmente diluída à medida que a cadeia causal se fragmenta. As estruturas de responsabilidade e os regimes de aplicação atuais não têm uma resposta estruturada para esse tipo de causalidade difusa.

A terceira é a representação de futuros não nascidos. Os sistemas de IA são treinados com base em dados históricos. Seus vieses são os do passado humano, amplificados em escala. Atualmente, nenhuma estrutura ética de IA incorpora mecanismos que representem os interesses de gerações que ainda não nasceram e, portanto, não produziram dados, mas que viverão com as consequências dos sistemas desenhados no presente. As implicações são diretas para aplicações com um longo escopo temporal, desde o planejamento urbano até a modelagem de riscos climáticos.

O quarto é o livre arbítrio como um risco sistêmico. Uma proporção cada vez maior de decisões individuais e organizacionais é de fato mediada por sistemas de IA cuja oferta é altamente concentrada: três fornecedores respondem por 88% dos gastos globais das empresas com modelos de linguagem, e o mercado de infraestrutura de nuvem subjacente é igualmente concentrado. Essa estrutura implica que um viés introduzido deliberada ou acidentalmente em um desses modelos não afeta decisões individuais, mas milhões de processos simultâneos em diferentes organizações, setores e países. A diversidade cognitiva de uma sociedade (ou seja, sua capacidade de chegar a conclusões diferentes por caminhos diferentes) depende, em parte, de os sistemas que mediam seu pensamento não serem homogêneos nem oligopolistas.

Essas quatro fraturas não são argumentos contra a adoção da IA, mas o território conceitual que as organizações que levam a sério o gerenciamento da adoção da IA devem aprender a habitar. A relevância dessas fraturas não é diminuída pela ausência delas nas estruturas regulatórias existentes; pelo contrário, é justamente a ausência delas que as torna os riscos com menor visibilidade e maior potencial de dano..

Índice deconteúdos

Introdução

Resumo Executivo

A explosão da tecnologia de IA

Governança da IA e impacto sobre as pessoas

Fronteiras da IA

Estudo de caso: GenMS™ Sybil

Conclusões

Referências e glossário