Tendencias en IA

La explosión tecnológica de la IA

Vídeo: Tendencias en IA

Índice de la publicación

Documento completo

Acceder a GenMS™ Sybil

Los sistemas de IA han cruzado umbrales críticos en los últimos años: ya no solo hablan, ejecutan; ya no solo sugieren, comenzamos a delegarles decisiones; ya no solo operan en entornos digitales, actúan sobre el mundo físico. Lo que comenzó como herramienta de productividad personal se ha convertido en infraestructura operativa capaz de automatizar procesos cognitivos complejos de extremo a extremo. Este bloque analiza cinco tendencias tecnológicas que redefinen los límites de lo posible, y que no describen el futuro: describen el presente operativo de organizaciones que ya están capturando ventajas competitivas estructurales gracias a la IA.

Democratización de la IA generativa multimodal

La transformación del trabajo intelectual En menos de cinco años, la IA generativa ha pasado de experimento tecnológico a infraestructura de productividad empresarial. Herramientas como Microsoft Copilot, ChatGPT Enterprise o Claude Enterprise se han desplegado masivamente en puestos de trabajo en todo el mundo: según Satya Nadella, Microsoft Copilot está presente en el 90% de las empresas Fortune 500 y ha superado los 150 millones de usuarios; y se estima que ChatGPT se acerca a los 900 millones de usuarios.

Esta velocidad de adopción no tiene precedentes en tecnologías empresariales: ni la nube, ni los dispositivos móviles, ni las plataformas colaborativas alcanzaron esta penetración con tal rapidez.

Lo que está ocurriendo no es una mejora incremental de herramientas existentes, sino una reconfiguración de cómo se realiza el trabajo intelectual. Tareas que antes requerían horas (redactar informes, analizar documentos extensos, generar código, crear presentaciones, sintetizar información dispersa) ahora producen un primer resultado útil en minutos mediante interacción conversacional con sistemas de IA.

Casos de adopción efectiva

Las mejoras de productividad ya son visibles; por citar algunos casos:

- En tareas de oficina estándar, se han medido mejoras de productividad del 10-13% en edición de documentos, reducciones del 11% en tiempo de procesamiento de email y aumentos del 23% en velocidad de resolución de incidencias de seguridad informática.

- Se ha observado que científicos que utilizan grandes modelos de lenguaje (LLMs) publican hasta un 50% más artículos científicos que antes de usar estas herramientas.

- Se ha medido que la automatización de procesos de negocio con IA generativa puede reducir más del 80% el tiempo de procesamiento de documentos corporativos, con menores tasas de error.

- En atención al cliente, la introducción de asistentes conversacionales con IA generativa permitió resolver un 14% más de incidencias en comparación con procesos tradicionales.

- Y una revisión sistemática de la adopción de la IA en el trabajo observa un aumento consistente de eficiencia y productividad en diversas tareas laborales tras la adopción de IA generativa, y también alerta de algunos riesgos vinculados a su uso.

La multimodalidad como salto cualitativo

Los modelos actuales integran texto, imágenes, audio, vídeo y código en una sola arquitectura generalista, tendencia que coexiste con el desarrollo paralelo de modelos altamente especializados que superan a los generalistas en dominios específicos. Un usuario puede subir una fotografía de un cuadro de mando financiero dibujado en una pizarra y obtener el código completo para reproducirlo; puede dictarle a un modelo una presentación completa mientras el sistema genera simultáneamente diapositivas con gráficos y tablas; puede proporcionarle una regulación completa a un sistema y obtener un podcast sobre ella; o puede pedirle que analice un vídeo de una reunión y extraiga decisiones, compromisos y plazos, por ejemplo.

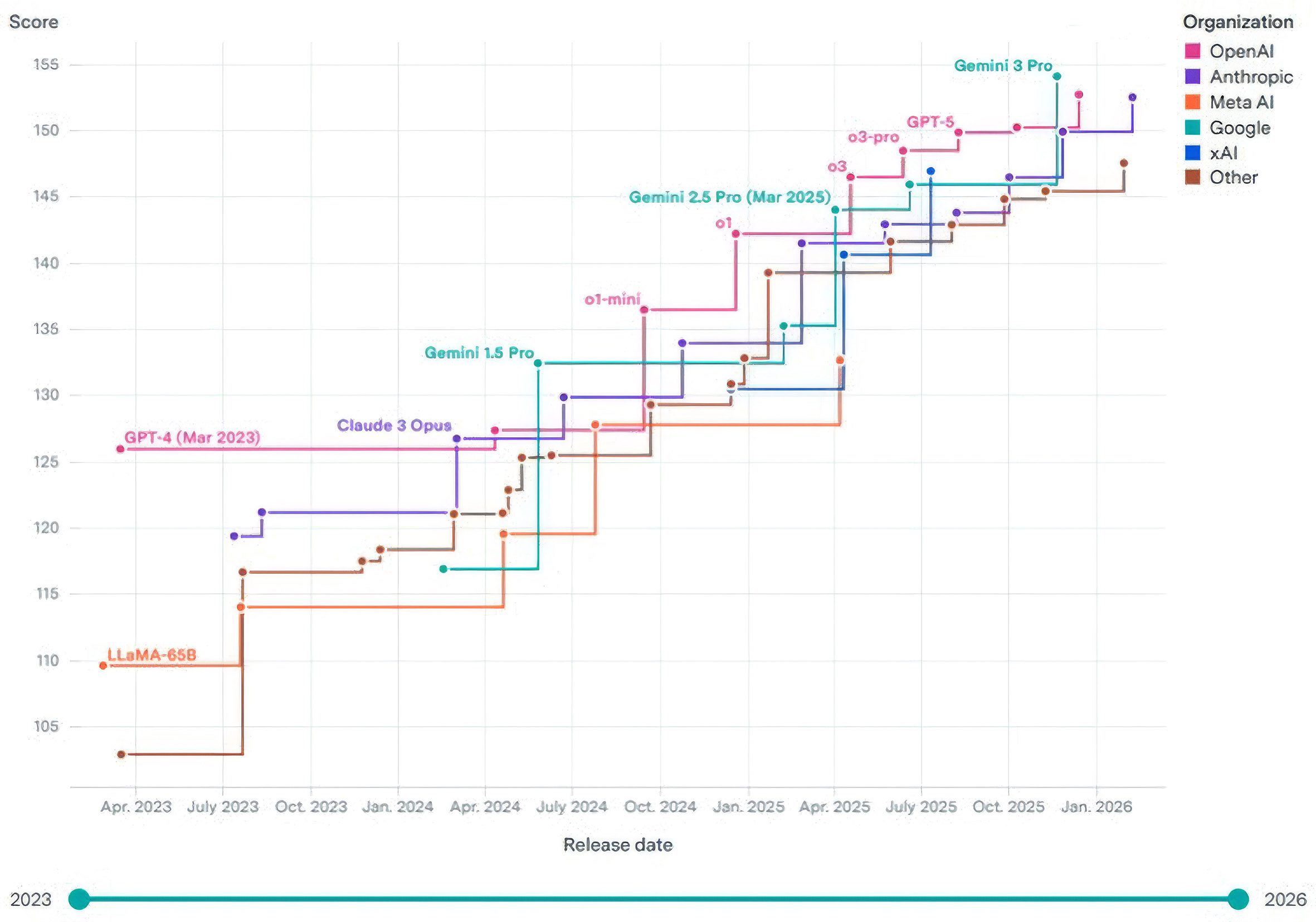

Esta convergencia multimodal no es menor: redefine la noción de qué tareas son automatizables. Tareas que antes requerían múltiples herramientas especializadas (e.g., transcripción de audio → análisis de texto → generación de gráficos → redacción de informe) ahora se resuelven en una sola interacción conversacional. Las capacidades de estos sistemas siguen aumentando trimestre a trimestre sin signos de desaceleración (Fig. 1), lo que implica que el impacto en velocidad y accesibilidad seguirá amplificándose.

Democratización: de expertos técnicos a perfiles no técnicos

La interfaz conversacional elimina barreras de entrada y supera el concepto de «citizen data scientist» (profesionales no técnicos capaces de realizar análisis básicos con herramientas visuales) para entregar las capacidades de análisis, generación de código y procesamiento avanzado directamente a usuarios finales, sin necesidad de formación técnica.

Esta democratización, sin embargo, tiene un doble filo: por un lado, libera capacidades productivas antes limitadas a especialistas; por otro, propaga el riesgo: ahora cualquier empleado puede, sin supervisión técnica, generar contenido, código o análisis que la organización podría utilizar en decisiones críticas. La pregunta clave no es si democratizar el acceso, sino cómo gobernar el uso a escala masiva.

El problema de verificación a escala

La IA generativa produce por diseño salidas plausibles, pero no necesariamente correctas, y la raíz de este problema es estructural: estos sistemas son modelos estadísticos que predicen la continuación más probable de una secuencia, no mecanismos que verifican la veracidad de lo que afirman. Esto crea una asimetría peligrosa: generar contenido es instantáneo; verificarlo requiere tiempo, conocimiento experto y disciplina. En octubre y noviembre de 2025, se reportó que una gran consultora había entregado dos informes para gobiernos que contenían citas y referencias fabricadas o inexactas, lo que obligó a reembolsos y correcciones, con un impacto reputacional muy relevante. Los informes habían sido elaborados con ayuda de IA generativa sin verificación rigurosa.

El riesgo no está en la herramienta, sino en los procesos de trabajo que no validan los resultados y las fuentes. Un profesional bien intencionado puede introducir errores catastróficos si confía ciegamente en salidas de IA sin contrastarlas; y este punto solo puede mitigarse con concienciación y alfabetización en IA.

Alfabetización en IA como requisito regulatorio

El Artículo 4 del Reglamento de IA europeo (AI Act), establece: «Los proveedores y responsables del despliegue de sistemas de IA adoptarán medidas para garantizar que, en la mayor medida posible, su personal […] tenga un nivel suficiente de alfabetización en materia de IA, teniendo en cuenta sus conocimientos técnicos, su experiencia, su educación y su formación, así como el contexto previsto de uso de los sistemas de IA y las personas o los colectivos de personas en que se van a utilizar dichos sistemas».

Esto no es una recomendación: es una obligación legal en vigor desde el 2 de febrero de 2025. Las organizaciones que tratan esto como un checkbox de cumplimiento están acumulando riesgo operativo y reputacional. Las que lo abordan como transformación cultural, integrando formación continua y comunidades de práctica, están capturando valor de forma sostenible.

La inevitabilidad de la adopción

La realidad es que esta tecnología ya está transformando la forma de trabajar, con o sin respaldo organizativo. Si las empresas no proporcionan herramientas corporativas securizadas y formación adecuada, los empleados utilizarán alternativas no controladas: cuentas personales en plataformas públicas, herramientas gratuitas sin garantías de privacidad, sistemas sin trazabilidad. Los estudios apuntan a que hasta un 35% de los datos que los profesionales suben a chatbots no securizados son confidenciales. El «shadow AI» no es una amenaza futura; es una realidad presente.

Por último, a nivel individual, la alfabetización en IA deja de ser opcional. Los profesionales que dominen estas herramientas (es decir, que comprendan cuándo y cómo usarlas, cómo verificar sus salidas, y cómo integrarlas en flujos de trabajo complejos) tendrán ventajas competitivas estructurales sobre quienes no lo hagan. La forma de trabajar ha cambiado de forma irreversible y la adaptación es ya una condición de competitividad profesional y organizativa.

Figura 1. Mejora continua de los LLM, medida sobre un índice sintético de capacidades. Fuente: Epoch (2025a).

|

Machine learning acelerado por IA generativa

La persistencia del machine learning en la empresa

Mientras la IA generativa acapara titulares, el machine learning (ML) clásico continúa siendo la columna vertebral de aplicaciones críticas en sectores como banca, seguros, retail, logística, energía o telecomunicaciones. Los modelos de credit scoring, detección de fraude, predicción de demanda, optimización de inventarios, mantenimiento predictivo, segmentación de clientes y motores de recomendación continúan operando mediante algoritmos (regresión logística, random forest, gradient boosting, redes neuronales…) entrenados sobre datos históricos estructurados. Estos sistemas no generan contenido como la IA generativa: clasifican, predicen y optimizan sobre la base de patrones aprendidos.

La IA generativa no sustituye estos modelos: los hace más rápidos de desarrollar, más fáciles de documentar, más eficientes de validar y más sencillos de desplegar. Por tanto, no los mejora directamente en términos estadísticos, sino que transforma el trabajo de los equipos que los construyen, documentan, validan y despliegan. La aceleración es del ciclo de desarrollo humano, no necesariamente del rendimiento predictivo del modelo resultante.

El ciclo de vida tradicional del ML: costoso y lento

Desarrollar un modelo de ML clásico ha sido tradicionalmente intensivo en tiempo de profesionales especializados. Un modelo predictivo típico requiere definición de variables (feature engineering), preparación y limpieza de datos, selección y entrenamiento de algoritmos, validación rigurosa, documentación exhaustiva, y despliegue en infraestructura productiva con monitorización continua. Este ciclo puede extenderse meses, y cada iteración o actualización del modelo replica gran parte del esfuerzo.

La IA generativa interviene en cada una de estas fases, y se ha demostrado que comprime significativamente los tiempos y libera capacidad de los perfiles más cualificados para centrarse en lo estratégico.

Aceleración del feature engineering

El feature engineering (la construcción de variables predictivas a partir de datos crudos) es uno de los aspectos más intensivos en conocimiento experto. Un data scientist debe combinar comprensión del negocio, intuición estadística y experimentación iterativa para identificar qué variables son relevantes. La IA generativa puede acelerar este proceso:

- Generación automatizada de variables: un LLM puede formular decenas de variables candidatas a partir de descripciones del problema de negocio y de la estructura de los datos disponibles.

- Traducción de lógica de negocio a código: un analista puede describir en lenguaje natural una lógica compleja (e.g., «quiero capturar la volatilidad de ingresos en los últimos 12 meses ajustada por estacionalidad») y obtener el código SQL o Python correspondiente en segundos.

- Optimización de pipelines de datos: la IA generativa puede revisar scripts de preparación de datos e identificar ineficiencias.

Estudios preliminares indican que data scientists asistidos por IA generativa «ahorran semanas de trabajo de feature engineering manual, mejorando el rendimiento de diversos modelos predictivos en múltiples escenarios de negocio».

Documentación automática y cumplimiento regulatorio

Los modelos de ML en sectores regulados deben estar exhaustivamente documentados. En banca, por ejemplo, los supervisores exigen que cada modelo regulado cuente con documentación que describa su objetivo, datos utilizados, metodología estadística, proceso de validación, resultados de backtesting, limitaciones conocidas y plan de monitorización, entre otros. Producir esta documentación es tedioso, consume tiempo de perfiles altamente cualificados y es propenso a inconsistencias cuando se actualiza el modelo.

La IA generativa puede automatizar gran parte de este proceso: generar documentación técnica a partir de código, traducir descripciones técnicas a resúmenes comprensibles para comités no técnicos o auditores, y actualizar automáticamente documentación cuando un modelo se reentrena con nuevos datos.

Validación asistida y detección de sesgos

La validación de modelos de ML es crítica y regulatoriamente obligatoria en muchos sectores. Incluye verificar la robustez estadística del modelo, evaluar su comportamiento en escenarios extremos y detectar sesgos no deseados. La IA generativa puede asistir generando y ejecutando automáticamente baterías completas de tests estadísticos relevantes, evaluando equidad algorítmica mediante métricas de fairness, y proponiendo y ejecutando escenarios de estrés realistas.

Despliegue y monitorización industrializada

Una vez validado, el modelo debe desplegarse en entornos productivos y monitorizarse continuamente para detectar degradación de rendimiento (model drift). La IA generativa acelera también esta fase: puede generar código de infraestructura (Docker, Kubernetes, pipelines CI/CD) para desplegar modelos de forma reproducible y escalable, producir dashboards de métricas de rendimiento, configurar alertas automáticas cuando se detectan anomalías, y generar scripts de reentrenamiento automático.

El ML clásico no desaparece: se industrializa

La IA generativa no reemplaza el machine learning tradicional, pero sí transforma radicalmente su ciclo de vida. Tareas que antes requerían semanas (feature engineering, documentación, validación) ahora se resuelven en días. Esto no significa que los data scientists sean prescindibles: significa que pueden dedicar más tiempo a lo estratégico (entender el problema de negocio, diseñar arquitecturas de modelos innovadoras, interpretar resultados) y menos a lo mecánico (escribir código repetitivo, redactar documentación estándar, ejecutar tests rutinarios).

El resultado neto es una aceleración del time-to-market de modelos de ML, una reducción de costes operativos, y una mejora en la calidad y trazabilidad de los sistemas desplegados. Para organizaciones intensivas en modelos predictivos, esta aceleración puede traducirse en ventajas competitivas materiales: capacidad de lanzar productos personalizados más rápido, de adaptar estrategias en tiempo real y de cumplir requisitos regulatorios con menor fricción operativa.

Apunte sectorial: los supervisores bancarios ante ML

Durante años, las entidades financieras europeas evitaron utilizar ML en modelos regulados (en particular, en modelos IRB para cálculo de capital regulatorio) por la creencia de que los supervisores lo rechazarían debido a problemas de explicabilidad. Esta percepción está cambiando.

En 2021, la EBA publicó un discussion paper sobre ML en modelos IRB donde reconocía que «las técnicas de machine learning tienen el potencial de mejorar la diferenciación de riesgo en modelos IRB» y establecía un conjunto de recomendaciones basadas en principios para garantizar un uso prudente de ML en este contexto. El documento no desincentivaba el uso de ML; al contrario, establecía cómo hacerlo compatible con la regulación existente (CRR).

La práctica lo confirma: varias entidades europeas han presentado al BCE modelos IRB basados en ML (por ejemplo, para carteras de pymes) y han sido aprobados, siempre que justifiquen adecuadamente la explicabilidad mediante técnicas como SHAP values, análisis de sensibilidad o descomposiciones de decisiones. La explicabilidad en ML no es una barrera insuperable: técnicas como SHAP o LIME permiten justificar decisiones de modelo ante supervisores con suficiente rigor. Sin embargo, está solo parcialmente resuelta: las metodologías XAI actuales responden bien ante audiencias técnicas y regulatorias, pero traducir esas explicaciones a términos comprensibles para un cliente minorista o un comité de dirección sigue siendo un desafío abierto.

Vibe coding y creación de software aumentada

De la programación tradicional al diálogo cognitivo con máquinas

El desarrollo de software ha evolucionado históricamente mediante saltos de abstracción: de la programación en ensamblador a lenguajes de alto nivel, de código imperativo a frameworks declarativos, de desarrollo manual a plataformas low-code. Cada transición eliminó complejidad técnica innecesaria y acercó la creación de software a la intención humana.

La IA generativa representa un salto cualitativo distinto: convierte la programación en una conversación iterativa con sistemas cognitivos. El programador ya no escribe código línea a línea: describe el comportamiento deseado en lenguaje natural, y el sistema genera, prueba, corrige y documenta. Este fenómeno, bautizado «vibe coding» por Andrej Karpathy, redefine qué significa programar: el desarrollador pasa de escribir sintaxis a dirigir sistemas cognitivos que materializan intención en software funcional. En palabras de Karpathy, «el vibe coding va a terraformar el software y alterar las descripciones de los puestos de trabajo».

¿Qué es realmente el vibe coding?

El vibe coding no es simplemente autocompletado de código sofisticado; es desarrollo de software mediante interacción iterativa en lenguaje natural con modelos de IA que mantienen memoria, contexto y comprensión de objetivos de alto nivel.

Sus componentes clave incluyen:

- Comprensión semántica del problema: el sistema interpreta requisitos expresados en lenguaje natural y los traduce a arquitectura técnica.

- Generación de código multiarchivo: el sistema produce no solo fragmentos, sino aplicaciones completas con estructura modular coherente.

- Ejecución, depuración y refactorización asistida: el sistema ejecuta código, detecta errores, propone correcciones y optimiza implementaciones.

- Producción automática de tests y documentación: el sistema genera automáticamente baterías de pruebas y documentación técnica sincronizada con el código.

- Fragilidad oculta: el código generado puede funcionar superficialmente, pero contener ineficiencias, vulnerabilidades o dependencias frágiles que solo se manifiestan en producción bajo carga o en casos extremos. A esto se suma un riesgo anterior en la cadena: las especificaciones ambiguas o mal formuladas, que antes un desarrollador senior habría cuestionado o reinterpretado con criterio, ahora se ejecutan literalmente sin fricción correctora, propagando el error de forma silenciosa desde el requisito hasta el producto.

- Dependencia del modelo: si el sistema de IA que generó el código desaparece o cambia significativamente, la capacidad de mantener o extender el software se degrada.

- Errores sistémicos replicados a escala: un error en el prompt o en la lógica del modelo puede propagarse instantáneamente a decenas de proyectos, multiplicando el impacto de fallos que antes habrían sido aislados.

- Repositorios de prompts: catalogar, versionar y auditar las instrucciones que generan código crítico, ya que el prompt se convierte en superficie de riesgo.

- Gestión de versiones de intención: registrar no solo qué código se produjo, sino qué objetivo se perseguía y qué restricciones se definieron.

- Control de autonomía y permisos: limitar explícitamente qué acciones puede ejecutar la IA (modificación de repositorios, despliegues, comandos, acceso a datos).

- Trazabilidad de decisiones de diseño: documentar qué decisiones fueron humanas y cuáles fueron propuestas o ejecutadas por la IA.

- Validación y revisión asistida: revisión sistemática de diffs, pruebas automáticas y auditorías de comportamiento antes de aceptar cambios en producción.

- Estado y memoria: mantiene contexto persistente entre interacciones, no solo dentro de una conversación aislada.

- Planificación dinámica: descompone objetivos complejos en subtareas, las prioriza y replanifica según resultados.

- Ejecución sobre sistemas reales: usa herramientas y APIs para modificar datos, ejecutar comandos y completar transacciones.

- Orquestación multiagente: coordina agentes especializados bajo un coordinador central que gestiona dependencias y traspaso de información.

- Trazabilidad completa: produce logs, evidencias y justificaciones de cada paso ejecutado, habilitando auditoría y supervisión.

- Deutsche Bank: está desplegando un AI voice-enabled agent («AI banking butler») que actúa como agente conversacional proactivo y cubre desde atención y soporte hacia la ejecución de transacciones y servicios de asesoramiento . El programa forma parte de una inversión tecnológica de aproximadamente 600 millones de euros, con un objetivo de ahorro recurrente de unos 300 millones de euros anuales hacia 2028, y se acompaña de una reducción cercana al 10% de la plantilla.

- Ryt Bank: banco malasio que se anuncia como «AI-first», opera sobre una arquitectura de agentes especializados donde el cliente interactúa en lenguaje natural y los agentes interpretan la intención, orquestan procesos y ejecutan transacciones reales sobre el core bancario. El sistema gestiona en torno a 80.000 transacciones al mes, ha reducido procesos que requerían 5-8 pantallas a una sola interacción conversacional, y ha mostrado una mejora significativa en la retención de clientes.

- Walmart: en sus centros de distribución automatizados, los sistemas de decisión autónoma coordinan almacenamiento, reposición y preparación de pedidos en tiempo real. Walmart reporta que estos centros duplican la capacidad de procesamiento con aproximadamente la mitad de la plantilla frente a centros tradicionales, evidenciando un cambio estructural en la productividad logística.

- Amazon: su nuevo sistema de gestión logística, Sequoia, orquesta robots, inventario y flujos de pedidos mediante software autónomo que decide dónde almacenar, cuándo mover inventario y cómo abastecer estaciones de recogida. Amazon reporta reducciones de hasta un 75% en el tiempo de manipulación de inventario y hasta un 25% en el tiempo de procesamiento de pedidos en los centros donde está desplegado.

- DHL: en operaciones de recogida con robots autónomos integrados con el WMS, los sistemas asignan trabajo, optimizan rutas y cierran tareas de forma automática. En despliegues productivos, DHL ha reportado incrementos de productividad de hasta +180% en unidades por hora, junto con mejoras significativas de calidad y precisión.

- 1. Interfaz y percepción: recibe objetivos del usuario, entrega resultados finales y percibe eventos del entorno mediante API gateways, endpoints y conectores de entrada.

- 2. Orquestación y planificación: descompone objetivos complejos en tareas manejables, decide qué agente ejecuta cada tarea y en qué orden, y gestiona colas de prioridades y enrutamiento.

3. Núcleo de agentes: trabajadores autónomos, cada uno con rol específico, núcleo cognitivo (LLM) y bucle de control ReAct (Reason + Act) que combina razonamiento y acción iterativa.

- 4. Herramientas y servicios: biblioteca de capacidades externas (búsqueda, generación de código, APIs corporativas) con conectividad estandarizada mediante protocolos como MCP y gestión de prompts.

- 5. Memoria y conocimiento: almacena información a corto plazo (historial de conversación), a largo plazo (base de datos vectorial con experiencias pasadas) y base de conocimiento corporativo.

- Tecnología y desarrollo: orquestación multiagente con coordinación efectiva, gestión de memoria operativa y de largo plazo, arquitecturas modulares que permitan mantenimiento y evolución, e integración segura con sistemas corporativos mediante estándares como MCP.

- Evaluación continua: métricas de desempeño, calidad y eficiencia, monitorización de desviaciones y anomalías, control de costes (las llamadas a modelos se multiplican exponencialmente), y trazabilidad completa de acciones y decisiones.

- Gobernanza y cumplimiento: supervisión humana mediante mecanismos de aprobación y escalado (teniendo presente que la capacidad humana de supervisión tiene un techo; superado ese límite, la supervisión se vuelve nominal y genera falsa sensación de control), controles y límites explícitos sobre qué acciones puede ejecutar cada agente, transparencia y explicabilidad funcional de las decisiones, y cumplimiento del AI Act y políticas internas de riesgo.

- Industrialización y modelo operativo: operación 24/7 con mantenimiento continuo, pipelines CI/CD para desplegar y actualizar agentes de forma segura, gestión activa de costes en producción, y resiliencia ante fallos o comportamientos inesperados.

- Transformación del modelo operativo: la IA agéntica introduce un cambio estructural donde equipos humanos colaboran con agentes autónomos que operan 24/7 sin supervisión continua. Comprime radicalmente el time-to-market: tareas que antes requerían semanas ahora se resuelven en días mediante delegación a agentes especializados.

- Riesgo de escalada de costes: a diferencia de la IA generativa tradicional, los agentes multiplican las llamadas a modelos y herramientas. Un prototipo viable puede convertirse en un sistema insostenible económicamente si no se diseña con controles de costes desde el inicio.

- Industrialización como barrera de entrada: construir prototipos agénticos es posible con frameworks actuales, pero operarlos, escalarlos, mantenerlos, securizarlos y auditarlos en producción requiere capacidades organizativas que la mayoría de empresas aún no han desarrollado. La ventaja competitiva no está en la tecnología, sino en la capacidad de industrializarla con gobernanza efectiva.

La diferencia con asistentes de código tradicionales es fundamental: estos completaban líneas o funciones; los sistemas de vibe coding comprenden objetivos, mantienen coherencia arquitectónica a lo largo de sesiones extendidas, y operan como colaboradores cognitivos, no como herramientas pasivas.

Aceleración y democratización del desarrollo de software

El impacto en velocidad de desarrollo es cuantificable y masivo. Un estudio de campo con 4.867 desarrolladores documentó un aumento del 26% en la tasa de compleción de tareas. Un experimento con 187.489 desarrolladores mostró un incremento del 12,4% en tiempo dedicado a actividades core de programación, acompañado de una reducción del 24,9% en tiempo dedicado a gestión de proyectos y tareas administrativas. En otras palabras: proyectos que antes requerían meses ahora se completan en semanas o días.

Otro efecto disruptivo es el igualador: la IA comprime la brecha de productividad entre desarrolladores junior y senior. Mientras los desarrolladores junior experimentan aumentos de productividad del 21% al 40%, los desarrolladores senior mejoran entre un 7% y un 16%. Esto no significa que la experiencia deje de importar, sino que el cuello de botella del desarrollo se desplaza: lo crítico ya no es dominar sintaxis, sino comprender problemas, diseñar arquitecturas robustas y formular restricciones con precisión.

Esta compresión de la brecha de habilidades tiene una consecuencia organizativa directa: la democratización profunda de la creación de software. Analistas de negocio, product managers, consultores y científicos están generando prototipos funcionales sin intermediación de equipos de ingeniería. El software deja de ser patrimonio exclusivo de perfiles técnicos especializados. La barrera de entrada ya no es el conocimiento de lenguajes de programación, sino la capacidad de articular problemas, objetivos y restricciones con claridad.

El resultado neto es una caída estructural del coste marginal de crear software, que conlleva un cambio de régimen económico en la producción de tecnología.

Transformación de los equipos de tecnología

Dentro de las organizaciones de tecnología, el reparto de roles está cambiando aceleradamente. Los equipos necesitan menos «programadores de bajo nivel» que escriban código rutinario, y más arquitectos de sistemas, diseñadores de soluciones, validadores de calidad y auditores de riesgo técnico. El rol de los desarrolladores senior evoluciona: dedican menos tiempo a sintaxis y más a gobernar arquitectura, seguridad, escalabilidad y gestión de deuda técnica.

Las investigaciones muestran que los equipos asistidos por IA requieren un 79,3% menos de colaboradores por proyecto en promedio, sin sacrificar complejidad técnica. Equipos pequeños están produciendo sistemas de escala y sofisticación antes reservados a grandes departamentos de ingeniería. Además, la exploración de nuevas tecnologías aumenta un 21,8%, lo que sugiere que los desarrolladores liberan capacidad cognitiva para aprender, experimentar y expandir sus capacidades técnicas.

Calidad, deuda técnica y riesgo

Sin embargo, la velocidad tiene costes ocultos. Generar código es instantáneo; mantenerlo, depurarlo y escalarlo sigue siendo difícil. El vibe coding introduce nuevos vectores de riesgo:

La naturaleza de la deuda técnica también cambia. Antes, la deuda técnica era principalmente deuda de código: implementaciones rápidas, refactorización pospuesta, duplicación de lógica. Ahora, la deuda técnica incluye deuda de arquitectura (decisiones de diseño implícitas en las interacciones con la IA), deuda de prompts (instrucciones mal formuladas que generan código subóptimo pero funcional) y deuda de trazabilidad (pérdida de comprensión de por qué el código hace lo que hace).

Gobernanza del software en la era del vibe coding

Si cualquiera puede crear software mediante conversación con IA, el riesgo organizativo se multiplica. El problema ya no es solo qué código existe, sino qué sistema cognitivo lo produjo, bajo qué instrucciones y con qué grado de autonomía.

Los principales marcos de seguridad y desarrollo ya están alertando de este cambio. OWASP identifica nuevos riesgos estructurales en aplicaciones basadas en LLM, como prompt injection, insecure output handling y excessive agency: dar a un sistema de IA capacidad de actuar sin controles suficientes.

Al mismo tiempo, NIST insiste en que los principios clásicos de desarrollo seguro (trazabilidad, revisión, pruebas, control de cambios, validación continua) deben aplicarse también al contenido generado por IA y a los mecanismos que lo convierten en cambios ejecutables.

En consecuencia, el gobierno del software deja de ser únicamente gobierno de código y se convierte en gobierno de sistemas cognitivos, lo que obliga a introducir nuevas capas de control:

Las propias herramientas de desarrollo con agentes ya recomiendan explícitamente estos guardarraíles (revisión de cambios, control de permisos, cautela con ejecución automática), reflejando que el riesgo no es teórico: la superficie de ataque y fallo se ha desplazado desde el código aislado hacia el bucle completo de intención → generación → ejecución.

En este nuevo entorno, las políticas de desarrollo ya no pueden limitarse a estándares de codificación y procesos de revisión. Deben incorporar reglas de uso de IA, definición de límites de autonomía y protocolos de validación de salidas generadas automáticamente. La gobernanza del software se convierte, por primera vez, en gobernanza de inteligencia operativa.

Implicaciones estratégicas

El vibe coding no es solo una tendencia tecnológica; es una variable macroeconómica. Las organizaciones que dominan esta capacidad operan con ventajas competitivas estructurales: time-to-market extremadamente comprimido, experimentación masiva a bajo coste y capacidad de adaptación organizativa acelerada.

Para empresas tradicionales, la implicación es clara: están compitiendo contra organizaciones que iteran diez veces más rápido, con equipos diez veces más pequeños y con costes marginales de desarrollo que tienden a cero. La velocidad de creación de software pasa de ser una métrica operativa interna a ser un determinante de supervivencia competitiva.

IA agéntica y sistemas autónomos

De asistentes conversacionales a operadores autónomos

La IA generativa ha transformado el trabajo intelectual al permitir que los profesionales generen contenido, analicen información y obtengan respuestas mediante conversación natural. Sin embargo, estos sistemas siguen siendo fundamentalmente reactivos: responden a prompts, pero no actúan de forma independiente sobre sistemas reales. La IA agéntica representa un salto cualitativo: sistemas que planifican, ejecutan tareas complejas, toman decisiones dentro de límites definidos y operan sobre infraestructuras corporativas con trazabilidad completa.

Un sistema agéntico opera mediante agentes autónomos, cada uno con capacidades específicas (razonamiento, memoria, uso de herramientas, planificación), que colaboran para alcanzar un objetivo definido. Las capacidades incrementales de la IA agéntica sobre la generativa son estructurales:

La IA agéntica en producción

La IA agéntica opera hoy en organizaciones globales que gestionan millones de transacciones diarias. Por citar algunos ejemplos:

¿Pero qué es un sistema agéntico? Cinco capas modulares

Esas capacidades funcionales se materializan en una arquitectura modular concreta (no simplemente un modelo de lenguaje con acceso a herramientas), compuesta por cinco capas interdependientes:

Esta arquitectura convierte la autonomía en algo trazable, auditable y gobernable. Cada decisión, cada acción, cada invocación de herramientas queda registrada, permitiendo supervisión humana efectiva y cumplimiento regulatorio.

MCP: el eslabón perdido de la escalabilidad

La arquitectura agéntica enfrenta un problema técnico fundamental: la complejidad exponencial de las integraciones. Tradicionalmente, cada modelo de lenguaje requiere una integración propietaria con cada herramienta. Cambiar de modelo obliga a reescribir todas las integraciones; agregar una nueva herramienta requiere integrarla con todos los modelos existentes. El resultado es deuda técnica exponencial.

Model Context Protocol (MCP) resuelve este problema mediante una capa de abstracción universal. MCP es un estándar abierto que normaliza cómo los modelos de IA interactúan con aplicaciones, fuentes de datos y herramientas externas. Los «servidores MCP» exponen capacidades (recursos, prompts, herramientas) que los «clientes MCP» (agentes o modelos) consumen bajo demanda. Una herramienta conectada a MCP es inmediatamente accesible a cualquier agente presente o futuro, sin redesarrollar integraciones.

El impacto de MCP es transformador: pasa de integraciones artesanales a activos reutilizables universales, facilita la transición de prototipos aislados a ecosistemas escalables, permite que los agentes adquieran nuevas capacidades sin redespliegues, y reduce drásticamente el coste de mantenimiento y evolución. Sin MCP o estándares equivalentes, la IA agéntica a escala empresarial no es técnicamente sostenible.

Gobernanza y control: el verdadero reto

Construir agentes es relativamente sencillo con los frameworks actuales; gobernarlos a escala empresarial es el desafío real. La adopción sostenible requiere equilibrar cuatro capacidades:

Implicaciones estratégicas

La adopción de IA agéntica tiene tres implicaciones estratégicas críticas:

IA en robótica y sistemas físicos

De lo digital a la acción en el mundo real

Durante años, la robótica industrial ha operado mediante sistemas programados para tareas repetitivas en entornos altamente controlados: brazos robóticos que ensamblan componentes siguiendo secuencias fijas, vehículos guiados automatizados (AGVs) que siguen rutas predefinidas, sistemas de «pick-and-place» que reconocen objetos en posiciones exactas. Estos robots ejecutan movimientos precisos, pero carecen de adaptabilidad: cualquier cambio en el entorno (un objeto fuera de lugar, una variación en la textura, un obstáculo inesperado) requiere reprogramación o intervención humana.

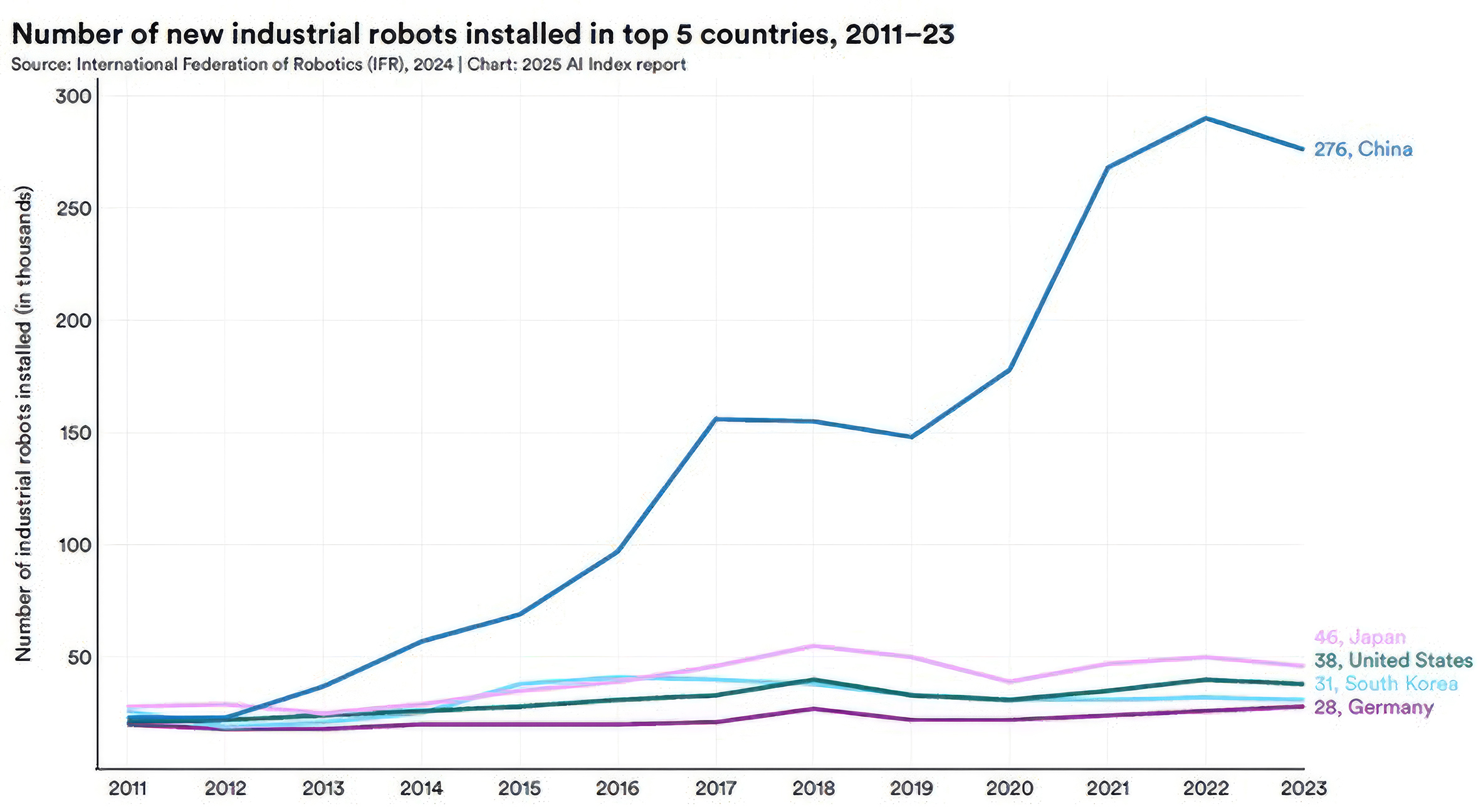

La integración de IA generativa, modelos de visión avanzados y aprendizaje por refuerzo está transformando esta realidad en la industria: solo en 2023 se instalaron más de 276.000 robots industriales en China (Fig. 2), que ya concentra más de la mitad de las instalaciones mundiales, y la proporción de robots colaborativos se ha cuadruplicado en seis años. Los robots actuales perciben su entorno mediante visión por computadora en tiempo real, interpretan instrucciones en lenguaje natural, planifican secuencias de acciones complejas, se adaptan a cambios imprevistos sin reprogramación y aprenden de cada interacción para mejorar continuamente. La IA convierte máquinas industriales rígidas en sistemas autónomos capaces de operar en entornos no estructurados y ejecutar tareas que antes requerían inteligencia humana.

Robots humanoides: del laboratorio a la fábrica

La robótica humanoide ha dado un salto cualitativo en los últimos dos años, pasando de demostraciones espectaculares de laboratorio a despliegues industriales reales.

Figure AI, startup valorada en aproximadamente 39.000 millones de dólares, completó en 2025 un despliegue de 11 meses de sus robots Figure 02 en la planta de BMW en Spartanburg (Carolina del Sur) . Los dos robots humanoides trabajaron turnos de 10 horas de lunes a viernes, acumulando 1.250 horas de operación, cargando más de 90.000 piezas de chapa metálica con tolerancias de 5 milímetros en 2 segundos por pieza, y contribuyendo a la producción de más de 30.000 vehículos BMW X3.

Figure ha lanzado su tercera generación, Figure 03, diseñada específicamente para producción en volumen. La compañía construyó BotQ, una planta de fabricación dedicada a robots humanoides con capacidad inicial de 12.000 unidades anuales y objetivo de producir 100.000 robots en cuatro años. Figure 03 incorpora carga inalámbrica inductiva (2 kW mediante bobinas en los pies que permiten al robot simplemente pisar una base para recargarse), un sistema de visión rediseñado con doble tasa de refresco y un cuarto del tiempo de latencia, y cámaras integradas en las palmas de las manos para retroalimentación visual redundante durante manipulación fina. La compañía proyecta que estos robots operarán mediante su IA propietaria Helix, entrenada masivamente con datos de teleoperación y demostraciones humanas.

Por su parte, Tesla está acelerando agresivamente la producción de su robot humanoide Optimus. La compañía anunció planes de construir una línea de producción capaz de fabricar un millón de unidades anuales, con inicio esperado hacia finales de 2026 . Elon Musk declaró en octubre de 2025 que la versión 3 de Optimus tendrá «manos que son una pieza increíble de ingeniería» con rango completo de movimiento humano (22 grados de libertad) y que el robot será tan realista que «necesitarás tocarlo para creer que es realmente un robot» . Tesla ha producido varios miles de unidades en 2025 para uso interno en sus fábricas (principalmente en tareas de manipulación de baterías y componentes), y planea escalar a 50.000-100.000 unidades en 2026 . Musk estima que, en volúmenes superiores al millón de unidades anuales, el coste de producción de Optimus caerá por debajo de 20.000 dólares, aproximadamente la mitad del coste de un Model Y a escala equivalente. El precio de venta al público, sin embargo, será significativamente mayor y determinado por demanda de mercado.

Boston Dynamics, referencia histórica en robótica dinámica, retiró en abril de 2024 su Atlas hidráulico (famoso por backflips y parkour) y lanzó un Atlas completamente eléctrico diseñado para aplicaciones industriales reales . El nuevo Atlas integra actuadores personalizados de alto rendimiento con rango de movimiento que excede capacidades humanas: su cabeza y torso pueden girar 180 grados independientemente, sus articulaciones tienen flexibilidad extrema, y está diseñado para explotar su propia anatomía mecánica, no para limitarse a las posturas humanas, aunque muchas de sus capacidades de control se entrenan a partir de movimiento humano. Boston Dynamics enfatiza que Atlas priorizará velocidad y eficiencia sobre apariencia antropomórfica.

En agosto de 2025, Boston Dynamics y Toyota Research Institute demostraron Atlas operando mediante Large Behavior Models (LBMs): políticas end-to-end entrenadas con demostraciones amplias y anotaciones de lenguaje que coordinan locomoción y manipulación simultáneamente. Un solo modelo de comportamiento controla directamente todo el robot, tratando manos y pies de forma casi idéntica, sin separar el control de bajo nivel de locomoción del control de manipulación. En videos públicos, Atlas realiza secuencias continuas de tareas de clasificación y embalaje en entornos simulados de fábrica, reaccionando autónomamente a perturbaciones físicas inesperadas (como investigadores cerrando cajas o empujando objetos) sin interrumpir la tarea. Boston Dynamics proyecta pilotos con Hyundai en 2026 y producción comercial limitada a partir de 2027.

Más allá de la manufactura y la logística, la robótica humanoide apunta a un segundo frente de impacto: el cuidado de personas mayores, dependientes o con discapacidad. En economías con envejecimiento estructural acelerado, esta aplicación tiene relevancia estratégica comparable a la industrial, con implicaciones éticas y regulatorias propias que los marcos actuales apenas han comenzado a abordar.

Implicaciones estratégicas y desafíos operativos

La integración de IA en robótica humanoide introduce cambios estructurales en manufactura y logística. La productividad aumenta radicalmente: robots operan 24/7 sin fatiga, descansos o variación de rendimiento. Los costes operativos recurrentes (energía, mantenimiento preventivo) son predecibles y decrecientes con economías de escala, aunque la inversión inicial sigue siendo significativa.

Sin embargo, surgen desafíos críticos. El impacto en empleo es real y concentrado: tareas manuales repetitivas en manufactura, ensamblaje y manipulación de materiales enfrentan automatización acelerada. Las organizaciones que adoptan robótica humanoide deben gestionar transiciones laborales, programas de reskilling, y expectativas regulatorias y sociales crecientes sobre responsabilidad corporativa, desafíos que comparte con la adopción de IA en general, pero que aquí adquieren mayor concentración sectorial y visibilidad social.

La dependencia de proveedores se intensifica: las empresas que adoptan robots quedan vinculadas a sus ecosistemas propietarios de hardware, software, actualizaciones de IA y soporte técnico. La obsolescencia tecnológica es rápida: un robot adquirido hoy puede quedar superado en capacidades por la siguiente generación en dos años, lo que plantea interrogantes sobre ciclos de inversión y estrategias de actualización.

Y emergen riesgos operativos nuevos: sistemas autónomos que operan en entornos físicos compartidos con humanos pueden causar lesiones, daños materiales o interrupciones operativas críticas si fallan. La robótica con IA requiere marcos de seguridad robustos (sensores redundantes, sistemas de parada de emergencia, zonas de exclusión dinámicas), protocolos de fail-safe certificados, y supervisión humana efectiva incluso en operaciones nominalmente autónomas.

La IA en robótica no es una tendencia futura, es una realidad operativa en fase de industrialización acelerada. Las organizaciones que evalúen estratégicamente cuándo y dónde adoptar robótica humanoide (no todas las tareas justifican la inversión) capturarán ventajas competitivas sostenibles.

Figura 2. Nuevos robots industriales instalados. Fuente: Stanford (2025).

|

Índice de la publicación

Introducción

Resumen ejecutivo

La explosión tecnológica de la IA

Gobierno de la IA e impacto en personas

Fronteras de la IA

Caso práctico: GenMS™ Sybil

Conclusión

Referencias y glosario