Tendências em Inteligência Artificial

A explosão da tecnologia de IA

Vídeo: TENDENCIAS EM IA

Índice da publicação

Download Documento

Acesso ao GenMS™ Sybil

Os sistemas de IA ultrapassaram limites críticos nos últimos anos: eles não apenas falam, eles executam; eles não apenas sugerem, nós começamos a delegar decisões a eles; eles não operam mais apenas em ambientes digitais, eles agem no mundo físico. O que começou como ferramenta de produtividade pessoal tornou-se uma infraestrutura operacional capaz de automatizar processos cognitivos complexos de ponta a ponta. Este bloco analisa cinco tendências tecnológicas que redefinem os limites do que é possível e não descrevem o futuro: elas descrevem o presente operacional das organizações que já estão capturando a vantagem competitiva estrutural por meio da IA.

Democratização da IA generativa multimodal

A transformação do trabalho intelectual

Em menos de cinco anos, a IA generativa passou de experimento tecnológico a infraestrutura de produtividade empresarial. Ferramentas como o Microsoft Copilot, o ChatGPT Enterprise ou o Claude Enterprise foram massivamente implantadas em locais de trabalho em todo o mundo: de acordo com Satya Nadella, o Microsoft Copilot está presente em 90% das empresas da Fortune 500 e ultrapassou 150 milhões de usuários; e estima-se que o ChatGPT esteja se aproximando de 900 milhões de usuários.

Essa velocidade de adoção não tem precedentes nas tecnologias empresariais: nem a nuvem, nem os dispositivos móveis, nem as plataformas de colaboração alcançaram essa penetração tão rapidamente.

O que está acontecendo não é uma melhoria incremental das ferramentas existentes, mas uma reconfiguração de como o trabalho intelectual é feito. Tarefas que costumavam levar horas - escrever relatórios, analisar documentos extensos, gerar códigos, criar apresentações, sintetizar informações dispersas - agora produzem um primeiro resultado útil em minutos por meio da interação conversacional com sistemas de IA.

Casos de adoção efetiva

As melhorias de produtividade já são visíveis, para citar alguns casos:

- Em tarefas padrão de escritório, foram medidas melhorias de produtividade de 10 a 13% na edição de documentos, reduções de 11% no tempo de processamento de e-mails e aumentos de 23% na velocidade de resolução de incidentes de segurança de computadores.

- Foi observado que os cientistas que usam large Language models (LLMs) publicam até 50% mais artigos científicos do que antes de usar essas ferramentas.

- Foi medido que a automação de processos de negócios com IA generativa pode reduzir o tempo de processamento de documentos corporativos em mais de 80%, com taxas de erro menores. Foi medido que a automação de processos de negócios com IA generativa pode reduzir o tempo de processamento de documentos corporativos em mais de 80%, com taxas de erro menores.

- No atendimento ao cliente, a introdução de assistentes de conversação com IA generativa permitiu que 14% mais incidentes fossem resolvidos em comparação com os processos tradicionais.

- E uma revisão sistemática da adoção da IA no local de trabalho observa um aumento consistente na eficiência e na produtividade em uma série de tarefas de trabalho após a adoção da IA generativa, e também alerta para alguns riscos associados ao seu uso.

Multimodalidade como um salto qualitativo

Os modelos atuais integram texto, imagens, áudio, vídeo e código em uma única arquitetura generalista, tendência que coexiste com o desenvolvimento paralelo de modelos altamente especializados que superam os generalistas em domínios específicos. Um usuário pode fazer upload de uma imagem de um painel financeiro desenhado em um quadro branco e obter o código completo para reproduzi-lo; pode ditar uma apresentação completa para um modelo enquanto o sistema gera simultaneamente slides com gráficos e tabelas; pode fornecer um regulamento completo para um sistema e obter um podcast sobre ele; ou pode pedir que ele analise um vídeo de uma reunião e extraia decisões, compromissos e prazos, por exemplo.

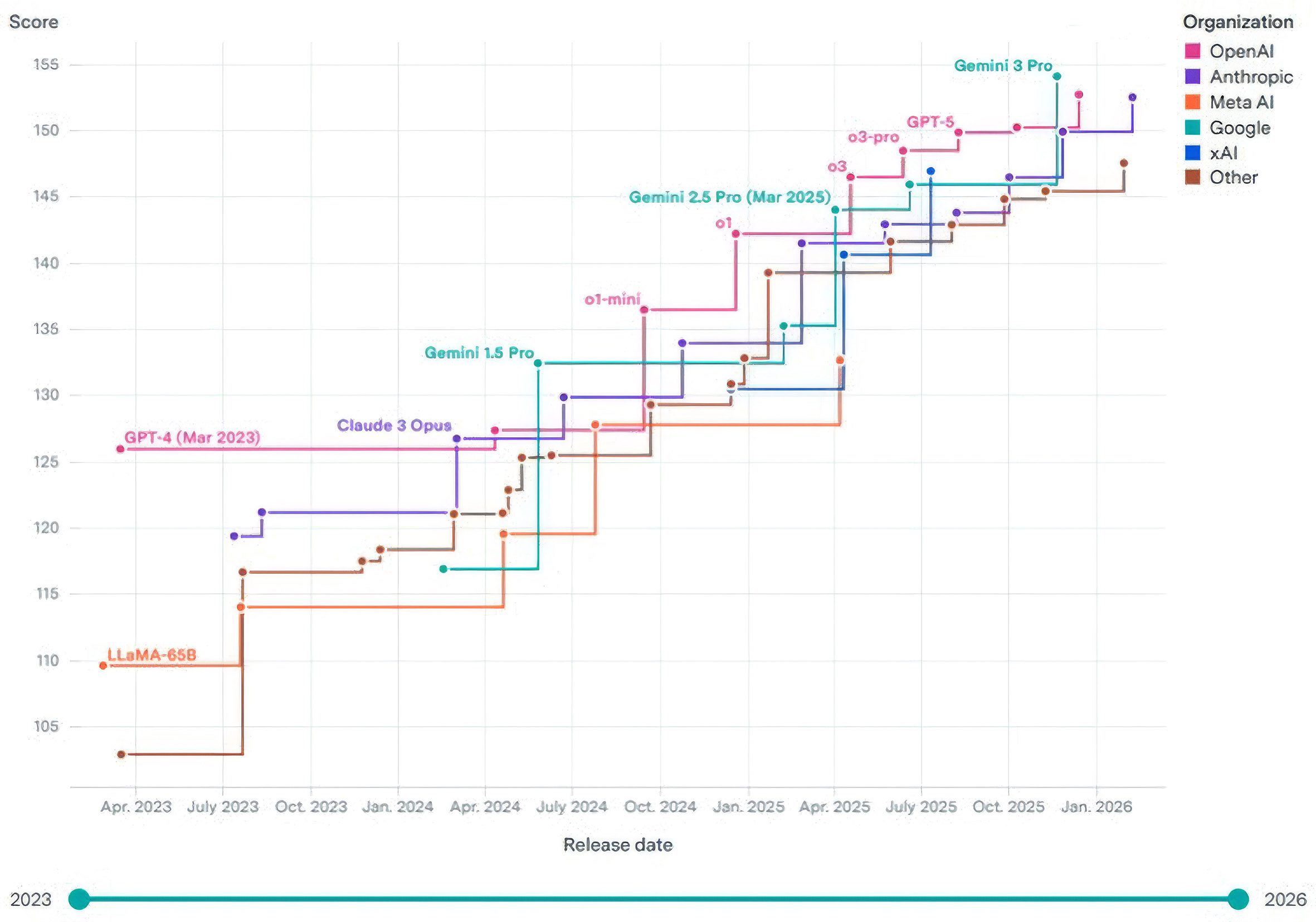

Essa convergência multimodal não é pequena: ela redefine a noção de quais tarefas são automatizáveis. As tarefas que antes exigiam várias ferramentas especializadas (por exemplo, transcrição de áudio > análise de texto > geração de gráficos > elaboração de relatórios) agora são resolvidas em uma única interação de conversação. Os recursos desses sistemas continuam a aumentar a cada trimestre, sem sinais de desaceleração (Fig. 1), o que implica que o impacto sobre a velocidade e a acessibilidade continuará a se ampliar.

Democratização: de especialistas técnicos a perfis não técnicos

A interface de conversação elimina as barreiras de entrada e supera o conceito de "citizen data scientist" (profissionais não técnicos capazes de realizar análises básicas com ferramentas visuais) para fornecer análise, geração de código e recursos avançados de processamento diretamente aos usuários finais, sem a necessidade de treinamento técnico.

Essa democratização, no entanto, tem um duplo aspecto: por um lado, libera recursos produtivos antes limitados a especialistas; por outro lado, espalha o risco: agora qualquer funcionário pode, sem supervisão técnica, gerar conteúdo, código ou análise que a organização poderia usar em decisões críticas. A principal questão não é democratizar o acesso, mas como controlar o uso em grande escala.

O problema da verificação em escala

A IA generativa produz resultados plausíveis, mas não necessariamente corretos, e a raiz desse problema é estrutural: estes sistemas são modelos estatísticos que prevêem a continuação mais provável de uma sequência, não mecanismos que verificam a veracidade do que afirmam. Isso cria uma assimetria perigosa: gerar conteúdo é instantâneo; verificá-lo requer tempo, conhecimento e disciplina. Em outubro e novembro de 2025, foi noticiado no site que uma grande consultoria havia entregue dois relatórios para governos que continham citações e referências fabricadas ou imprecisas, forçando reembolsos e correções, com impacto significativo na reputação. Os relatórios haviam sido produzidos com a ajuda de IA generativa sem verificação rigorosa.

O risco não está na ferramenta, mas nos processos de trabalho que não validam os resultados e as fontes. Um profissional bem-intencionado pode introduzir erros catastróficos se confiar cegamente em resultados de IA não verificados; e esse ponto só pode ser mitigado com a conscientização e a alfabetização em IA.

Alfabetização em IA como requisito regulatório

O artigo 4 do Regulamento Europeu de IA (AI Act) declara : «"Os provedores e os responsáveis pela implantação de sistemas de IA devem tomar medidas para garantir que, na medida do possível, seu pessoal [...] tenha um nível suficiente de alfabetização em IA, levando em conta seu conhecimento técnico, experiência, educação e treinamento, bem como o contexto pretendido de uso dos sistemas de IA e as pessoas ou grupos de pessoas nos quais os sistemas de IA devem ser usados."

Isso não é uma recomendação: é uma obrigação legal em vigor desde 2 de fevereiro de 2025. As organizações que tratam isso como uma mera formalidade de compliance estão acumulando riscos operacionais e de reputação. Aquelas que o abordam como uma transformação cultural, integrando aprendizado contínuo e comunidades de prática, estão capturando valor de forma sustentável.

A inevitabilidade da adoção

A realidade é que essa tecnologia já está transformando a maneira como trabalhamos, com ou sem apoio organizacional. Se as empresas não fornecerem ferramentas corporativas seguras e treinamento adequado, os funcionários usarão alternativas sem controle: contas pessoais em plataformas públicas, ferramentas gratuitas sem garantias de privacidade, sistemas não rastreáveis. Estudos sugerem que até 35% dos dados que os profissionais enviam para chatbots não seguros são confidenciais. A shadow IA não é uma ameaça futura; é uma realidade presente.

Por fim, em nível individual, a alfabetização em IA não é mais opcional. Os profissionais que dominam essas ferramentas (ou seja, que entendem quando e como usá-las, como verificar seus resultados e como integrá-las a fluxos de trabalho complexos) terão vantagens competitivas estruturais sobre aqueles que não as dominam. A maneira de trabalhar mudou de forma irreversível e a adaptação é agora uma condição de competitividade profissional e organizacional.

Fig. 1. Melhoria contínua dos LLMs, medida em um índice sintético de habilidades. Font: Epoch (2025a).

|

Machine learning acelerado pela IA generativa

A persistência do machine learning na empresa

Embora a IA generativa esteja ganhando as manchetes, o machine learning (ML) clássico continua a ser a espinha dorsal de aplicativos essenciais em setores como bancos, seguros, varejo, logística, energia e telecomunicações. Os modelos de scoring de crédito, detecção de fraudes, previsão de demanda, otimização de estoque, manutenção preditiva, segmentação de clientes e mecanismos de recomendação continuam a operar usando algoritmos (regressão logística, random forests, gradient boosting, redes neurais...) treinados em dados históricos estruturados. Esses sistemas não geram conteúdo como a IA generativa: eles classificam, preveem e otimizam com base em padrões aprendidos.

A IA generativa não substitui esses modelos: ela os torna mais rápidos de desenvolver, mais fáceis de documentar, mais eficientes de validar e mais simples de implantar.

O ciclo de vida tradicional do ML: caro e demorado

Tradicionalmente, o desenvolvimento de um modelo clássico de ML consome muito tempo de profissionais especializados. Um modelo preditivo típico requer definição de variáveis (feature engineering), preparação e limpeza de dados, seleção e treinamento de algoritmos, validação rigorosa, documentação completa e implantação na infraestrutura de produção com monitoramento contínuo. Esse ciclo pode se estender por meses, e cada iteração ou atualização de modelo replica grande parte do esforço.

A IA generativa está envolvida em cada uma dessas fases, e foi demonstrado que ela comprime significativamente o tempo e libera capacidade para que os perfis mais qualificados se concentrem no estratégico.

Aceleração do feature engineering

O feature engineering (a construção de variáveis preditivas a partir de dados brutos) é um dos aspectos da ciência de dados que mais exige conhecimento. Um cientista de dados deve combinar o entendimento do negócio, a intuição estatística e a experimentação iterativa para identificar quais variáveis são relevantes. A IA generativa pode acelerar esse processo:

- Geração automatizada de variáveis: um LLM pode formular dezenas de variáveis candidatas a partir de descrições do problema de negócios e da estrutura dos dados disponíveis.

- Tradução da lógica de negócios em código: um analista pode descrever em linguagem natural uma lógica complexa (por exemplo, "Quero capturar a volatilidade da receita ajustada sazonalmente nos últimos 12 meses") e obter o código SQL ou Python correspondente em segundos.

- Otimização do pipeline de dados: a IA generativa pode revisar os scripts de preparação de dados e identificar ineficiências.

Estudos preliminares indicam que os cientistas de dados auxiliados pela IA generativa "economizam semanas de trabalho manual de engenharia de atributos, melhorando o desempenho de vários modelos preditivos em vários cenários de negócios".

Documentação automatizada e compliance regulatório

Os modelos de ML em setores regulados devem ser minuciosamente documentados. No setor bancário, por exemplo, os supervisores exigem que cada modelo regulado tenha uma documentação que descreva sua finalidade, os dados usados, a metodologia estatística, o processo de validação, os resultados do backtesting, as limitações conhecidas e o plano de monitoramento, entre outros. A produção dessa documentação é tediosa, consome muito tempo para perfis altamente qualificados e está sujeita a inconsistências ao atualizar o modelo

A IA generativa pode automatizar grande parte desse processo: gerar documentação técnica a partir do código, traduzir descrições técnicas em resumos compreensíveis para comitês ou auditores não técnicos e atualizar automaticamente a documentação quando um modelo é retreinado com novos dados.

Validação assistida e detecção de viés

A validação de modelos de ML é essencial e obrigatória em muitos setores. Ela inclui a verificação da robustez estatística do modelo, a avaliação de seu comportamento em cenários extremos e a detecção de vieses indesejados. A IA generativa pode ajudar gerando e executando automaticamente baterias completas de testes estatísticos relevantes, avaliando a imparcialidade do algoritmo por meio de métricas de fairness e propondo e executando cenários de estresse realistas.

Implementação e monitoramento industrializados

Depois de validado, o modelo deve ser implantado em ambientes de produção e monitorado continuamente quanto à degradação do desempenho (model drift). A IA generativa também acelera essa fase: ela pode gerar código de infraestrutura (Docker, Kubernetes, pipelines de CI/CD) para implantar modelos de forma reproduzível e dimensionável, produzir dashboards de métricas de desempenho, configurar alertas automáticos quando anomalias são detectadas e gerar scripts de retreinamento automático.

O ML clássico não está desaparecendo: ele está se industrializando

A IA generativa não substitui o machine learning tradicional, mas transforma radicalmente seu ciclo de vida. As tarefas que costumavam levar semanas (feature engineering, documentação, validação) agora são resolvidas em dias. Isso não significa que os cientistas de dados sejam dispensáveis: significa que eles podem dedicar mais tempo ao estratégico (entender o problema comercial, projetar arquiteturas de modelos inovadores, interpretar resultados) e menos ao mecânico (escrever código repetitivo, escrever documentação padrão, executar testes de rotina).

O resultado líquido é uma aceleração no tempo de colocação dos modelos de ML no mercado, uma redução nos custos operacionais e uma melhoria na qualidade e na rastreabilidade dos sistemas implantados. Para as organizações que utilizam intensivamente a modelagem preditiva, essa aceleração pode se traduzir em vantagens competitivas significativas: a capacidade de lançar produtos personalizados mais rapidamente, de adaptar estratégias em tempo real e de atender aos requisitos regulatórios com menos atrito operacional.

Nota setorial: supervisores bancários ante o ML

Durante anos, as instituições financeiras europeias evitaram usar o ML em modelos regulados (particularmente, em modelos IRB para cálculos de capital regulatório), acreditando que os supervisores o rejeitariam devido a problemas de explicabilidade. Essa percepção está mudando.

Em 2021, a EBA publicou um documento de discussão sobre ML em modelos IRB, no qual reconheceu que "as técnicas de machine learning têm o potencial de melhorar a diferenciação de risco em modelos IRB" e definiu um conjunto de recomendações baseadas em princípios para garantir o uso prudente de ML nesse contexto. O documento não desencorajou o uso de ML; pelo contrário, definiu como torná-lo compatível com a regulação existente (CRR).

A prática confirma isso: várias instituições europeias apresentaram ao BCE modelos IRB baseados em ML (por exemplo, para carteiras de PMEs) ao BCE e foram aprovados, desde que justifiquem adequadamente a explicabilidade por meio de técnicas como SHAP values, análise de sensibilidade ou decomposições de decisões. A explicabilidade no ML não é uma barreira intransponível: técnicas como SHAP ou LIME permitem justificar decisões de modelo perante supervisores com rigor suficiente. No entanto, essa questão está apenas parcialmente resolvida: as metodologias XAI atuais respondem bem a públicos técnicos e regulatórios, mas traduzir essas explicações em termos compreensíveis para um cliente de varejo ou um conselho de administração continua sendo um desafio a ser superado.

Vibe coding e engenharia de software aumentada

Da programação tradicional ao diálogo cognitivo com as máquinas

Historicamente, o desenvolvimento de software evoluiu por meio de saltos de abstração: da programação em assembly para linguagens de alto nível, do código imperativo para frameworks declarativos, do desenvolvimento manual para plataformas low-code. Cada transição eliminou a complexidade técnica desnecessária e aproximou a criação de software da intenção humana.

A IA generativa representa um salto qualitativo distinto: ela transforma a programação em uma conversa iterativa com sistemas cognitivos. O programador não escreve mais o código linha por linha: ele descreve o comportamento desejado em linguagem natural, e o sistema o gera, testa, corrige e documenta. Esse fenômeno, chamado de "vibe coding" por Andrej Karpathy, redefine o que significa programar: o desenvolvedor deixa de escrever sintaxe e passa a dirigir sistemas cognitivos que materializam a intenção em software funcional. Nas palavras de Karpathy, "o vibe coding transformará o software e alterará as descrições de cargos".

O que é realmente o vibe coding?

O Vibe coding não é simplesmente o preenchimento automático de códigos sofisticados; é o desenvolvimento de software por meio da interação iterativa de linguagem natural com modelos de IA que mantêm a memória, o contexto e a compreensão de objetivos de alto nível.

Seus principais componentes incluem:

- Compreensão semântica do problema: o sistema interpreta os requisitos expressos em linguagem natural e os traduz em arquitetura técnica.

- Geração de código multiarquivo: o sistema produz não apenas fragmentos, mas aplicativos completos com estrutura modular coerente.

- Execução assistida, depuração e refatoração: o sistema executa o código, detecta erros, propõe correções e otimiza as implementações.

- Produção automática de testes e documentação: o sistema gera automaticamente baterias de testes e documentação técnica sincronizada com o código.

- Fragilidade oculta: o código gerado pode funcionar superficialmente, mas contém ineficiências, vulnerabilidades ou dependências frágeis que só se manifestam na produção sob carga ou em casos extremos. A isso se soma um risco anterior na cadeia: as especificações ambíguas ou mal formuladas, que antes um desenvolvedor sênior teria questionado ou reinterpretado com bom senso, agora são executadas literalmente sem qualquer correção, propagando o erro silenciosamente desde o requisito até o produto.

- Dependência do modelo: se o sistema de IA que gerou o código desaparecer ou mudar significativamente, a capacidade de manter ou estender o software será prejudicada.

- Bugs sistêmicos replicados em escala: um bug no prompt ou na lógica do modelo pode se propagar instantaneamente para dezenas de projetos, multiplicando o impacto de bugs que antes seriam isolados.

- Repositórios de prompts: instruções de catálogo, versão e auditoria que geram código crítico, pois o prompt se torna uma superfície de risco.

- Gestão de versões de intenção: registrar não apenas qual código foi produzido, mas também qual objetivo foi perseguido e quais restrições foram definidas.

- Controle de autonomia e permissões: limitar explicitamente as ações que a IA pode executar (modificação de repositório, implementações, comandos, acesso a dados).

- Rastreabilidade das decisões de projeto: documentar quais decisões foram tomadas por humanos e quais foram propostas ou executadas pela IA.

- Validação e revisão assistida: revisão sistemática de diffs, testes automatizados e auditorias de comportamento antes de aceitar alterações em produção.

- Status e memória: mantém um contexto persistente entre as interações, não apenas em uma conversa isolada.

- Planejamento dinâmico: decompõe metas complexas em subtarefas, prioriza-as e replaneja de acordo com os resultados.

- Execução em sistemas reais: usa ferramentas e APIs para modificar dados, executar comandos e concluir transações.

- Orquestração multiagente: coordena agentes especializados sob um coordenador central que gerencia dependências e transferência de informações.

- Rastreabilidade completa: produz registros, evidências e justificativas de cada etapa executada, permitindo auditoria e supervisão.

- Deutsche Bank: está implantando um agente habilitado para voz de IA ("AI banking butler") que atua como um agente de conversação proativo, desde o atendimento e suporte até a execução de transações e serviços de consultoria. O programa faz parte de um investimento em tecnologia de aproximadamente 600 milhões de euros, com uma meta de economia recorrente de cerca de 300 milhões de euros por ano até 2028, e é acompanhado por uma redução de cerca de 10% na força de trabalho.

- Ryt Bank: banco malaio que se anuncia como "AI-first", opera em uma arquitetura de agentes especializados em que o cliente interage em linguagem natural e os agentes interpretam a intenção, orquestram processos e executam transações reais no core banking. O sistema lida com cerca de 80.000 transações por mês, reduziu processos que exigiam de 5 a 8 telas para uma única interação de conversação e demonstrou uma melhoria significativa na retenção de clientes.

- Walmart: em seus centros de distribuição automatizados, os sistemas de decisão autônomos coordenam o armazenamento, o reabastecimento e a coleta de pedidos em tempo real. O Walmart informa que esses centros dobram a capacidade de processamento com aproximadamente metade da equipe em comparação com os centros tradicionais, demonstrando uma mudança estrutural na produtividade logística.

- Amazon: seu novo sistema de gerenciamento de logística, o Sequoia, orquestra robôs, estoque e fluxos de pedidos por meio de um software autônomo que decide onde armazenar, quando mover o estoque e como estocar as estações de coleta. A Amazon relata reduções de até 75% no tempo de manuseio do estoque e de até 25% no tempo de processamento de pedidos nos centros onde está implantado.

- DHL: Em operações de separação com robôs autônomos integrados ao WMS, os sistemas atribuem trabalho automaticamente, otimizam rotas e encerram tarefas. Em implantações produtivas, a DHL relatou aumentos de produtividade de até +180% em unidades por hora, juntamente com melhorias significativas na qualidade e na precisão.

- 1. Interface e percepção: recebe metas do usuário, fornece resultados finais e percebe eventos do ambiente por meio de gateways de API, pontos de extremidade e conectores de entrada. .

- 2. Orquestração e agendamento: decomposes complex goals into manageable tasks, decides which agent executes each task and in what order, and manages priority queuing and routing.

- 3. Núcleo do agente: trabalhadores autônomos, cada um com uma função específica, núcleo cognitivo (LLM) e loop de controle ReAct (Reason + Act) que combina raciocínio e ação iterativa.

- 4. Ferramentas e serviços:biblioteca de recursos externos (pesquisa, geração de código, APIs corporativas) com conectividade padronizada por meio de protocolos como MCP e gerenciamento de prompts.

- 5. Memória e conhecimento: armazena informações de curto prazo (histórico de conversas), informações de longo prazo (banco de dados de vetores com experiências passadas) e base de conhecimento corporativo.

- Tecnologia e desenvolvimento: multi-agent orchestration with effective coordination, operational and long-term memory management, modular architectures that allow maintenance and evolution, and secure integration with corporate systems through standards such as MCP.

- Avaliação contínua: métricas de desempenho, qualidade e eficiência, monitoramento de desvios e anomalias, controle de custos (as chamadas para modelos se multiplicam exponencialmente) e rastreabilidade total de ações e decisões.

- Governança e compliance: supervisão humana por meio de mecanismos de aprovação e escalonamento, (levando em conta que a capacidade humana de supervisão tem um limite; uma vez ultrapassado esse limite, a supervisão torna-se meramente formal e gera uma falsa sensação de controle) controles explícitos e limites sobre as ações que cada agente pode executar, transparência e explicabilidade funcional das decisões e compliance com o AI Act e as políticas internas de risco.

- Industrialização e modelo operacional: operação 24 horas por dia, 7 dias por semana, com manutenção contínua, pipelines de CI/CD para implantar e atualizar agentes com segurança, gerenciamento ativo de custos na produção e resiliência a falhas ou comportamentos inesperados.

- Transformação do modelo operacional: a IA agêntica introduz uma mudança estrutural em que as equipes humanas colaboram com agentes autônomos que operam 24 horas por dia, 7 dias por semana, sem supervisão contínua. Ela reduz radicalmente o tempo de colocação no mercado: tarefas que costumavam levar semanas agora são resolvidas em dias por meio da delegação a agentes especializados.

- Risco de aumento de custos: ao contrário da IA generativa tradicional, os agentes multiplicam as chamadas para modelos e ferramentas. Um protótipo viável pode se tornar um sistema financeiramente insustentável se não for projetado com controles de custo desde o início.

- Industrialização como barreira de entrada: a criação de protótipos agênticos é possível com as estruturas atuais, mas operá-los, dimensioná-los, mantê-los, protegê-los e auditá-los na produção exige recursos organizacionais que a maioria das empresas ainda não desenvolveu. A vantagem competitiva não está na tecnologia, mas na capacidade de industrializá-la com uma governança eficaz.

A diferença em relação aos assistentes de código tradicionais é fundamental: essas linhas ou funções são concluídas; os sistemas de vie coding entendem os objetivos, mantêm a coerência arquitetônica durante sessões prolongadas e operam como colaboradores cognitivos, não como ferramentas passivas.

Aceleração e democratização do desenvolvimento de software

O impacto na velocidade do desenvolvimento é quantificável e massivo. Um estudo de campo com 4.867 desenvolvedores documentou um aumento de 26% na taxa de conclusão de tarefas. Um experimento com 187.489 desenvolvedores mostrou um aumento de 12,4% no tempo gasto em atividades essenciais de programação, acompanhado por uma redução de 24,9% no tempo gasto em gestão de projetos e tarefas administrativas. Em outras palavras: projetos que costumavam levar meses agora são concluídos em semanas ou dias.

Outro efeito disruptivo é o equalizador: a IA reduz a diferença de produtividade entre desenvolvedores juniores e seniores. Enquanto os desenvolvedores juniores experimentam ganhos de produtividade de 21% a 40%, os desenvolvedores sênior melhoram de 7% a 16%. Isso não significa que a experiência não seja mais importante, mas que o gargalo do desenvolvimento está mudando: não é mais essencial dominar a sintaxe, mas sim entender os problemas, projetar arquiteturas robustas e formular restrições com precisão.

Essa compreensão da lacuna de habilidades tem uma consequência organizacional direta: a profunda democratização da criação de software. Analistas de negócios, gerentes de produtos, consultores e cientistas estão gerando protótipos funcionais sem a intermediação de equipes de engenharia. O software não é mais exclusividade de perfis técnicos especializados. A barreira de entrada não é mais o conhecimento de linguagens de programação, mas a capacidade de articular problemas, objetivos e restrições com clareza.

O resultado líquido é uma queda estrutural no custo marginal da criação de software, levando a uma mudança de regime econômico na produção de tecnologia.

Transformação das equipes de tecnologia

Nas organizações de tecnologia, a distribuição de funções está mudando rapidamente. As equipes precisam de menos "programadores de baixo nível" escrevendo códigos de rotina e mais arquitetos de sistemas, designers de soluções, validadores de qualidade e auditores de riscos técnicos. A função dos desenvolvedores sênior está evoluindo: eles passam menos tempo na sintaxe e mais na governança da arquitetura, segurança, escalabilidade e gerenciamento de dívida técnica.

A pesquisa mostra que as equipes assistidas por IA exigem, em média, 79,3% menos colaboradores por projeto, sem sacrificar a complexidade técnica. Pequenas equipes estão produzindo sistemas de escala e sofisticação antes reservados a grandes departamentos de engenharia. Além disso, a exploração de novas tecnologias aumentou 21,8%, o que sugere que os desenvolvedores estão liberando a capacidade cognitiva para aprender, experimentar e expandir suas capacidades técnicas.

Qualidade, dívida técnica e risco

No entanto, a velocidade tem custos ocultos. A geração de código é instantânea; a manutenção, a depuração e o dimensionamento continuam difíceis. O vibe coding introduz novos vetores de risco:

A natureza do débito técnico também está mudando. Antes, a dívida técnica era principalmente dívida de código: implementações rápidas, refatoração adiada, duplicação de lógica. Agora, o débito técnico inclui dívidas de arquitetura (decisões de design implícitas nas interações com a IA), dívidas de prompts (instruções mal formuladas que geram código abaixo do ideal, mas funcional) e dívidas de rastreabilidade (perda de compreensão do motivo pelo qual o código faz o que faz).

Governança de software na era do vibe coding

Se qualquer pessoa pode criar software por meio de conversas com IA, o risco organizacional se multiplica. O problema não é mais apenas saber qual código existe, mas qual sistema cognitivo o produziu, sob quais instruções e com qual grau de autonomia.

As principais estruturas de segurança e desenvolvimento já estão alertando sobre essa mudança. A OWASP identifica novos riscos estruturais em aplicativos baseados em LLM, como prompt injection, insecure output handling e excessive agency: dar a um sistema de IA a capacidade de agir sem controles suficientes.

Ao mesmo tempo, o NIST insiste que os princípios clássicos do desenvolvimento seguro (rastreabilidade, revisão, teste, controle de alterações, validação contínua) também devem ser aplicados ao conteúdo gerado pela IA e aos mecanismos que o transformam em alterações executáveis.

Como resultado, a governança de software não é mais apenas governança de código, mas governança de sistemas cognitivos, o que exige a introdução de novas camadas de controle:

As próprias ferramentas de desenvolvimento baseadas em agentes já recomendam explicitamente essas proteções (revisão de alterações, controle de permissões, cautela com a execução automática), refletindo que o risco não é teórico: a superfície de ataque e falha mudou do código isolado para o ciclo completo de intenção > geração > execução.

Implicações estratégicas

O vibe coding não é apenas uma tendência tecnológica; é uma variável macroeconômica. As organizações que dominam esse recurso operam com vantagens competitivas estruturais: tempo de colocação no mercado extremamente reduzido, experimentação massiva de baixo custo e adaptabilidade organizacional acelerada.

Para as empresas tradicionais, a implicação é clara: elas estão competindo com organizações que iteram dez vezes mais rápido, com equipes dez vezes menores e com custos marginais de desenvolvimento que tendem a zero. A velocidade de criação de software deixa de ser uma métrica operacional interna e passa a ser um determinante da sobrevivência competitiva.

IA agêntica e sistemas autônomos

De assistentes de conversação a operadores autônomos

A IA generativa transformou o trabalho intelectual ao permitir que os profissionais gerassem conteúdo, analisassem informações e obtivessem respostas por meio de conversas naturais. No entanto, esses sistemas permanecem fundamentalmente reativos: eles respondem a solicitações, mas não agem de forma independente em sistemas reais. A IA agêntica representa um salto quântico: sistemas que planejam, executam tarefas complexas, tomam decisões dentro de limites definidos e operam em infraestruturas corporativas com rastreabilidade total.

Um sistema agêntico opera por meio de agentes autônomos, cada um com recursos específicos (raciocínio, memória, uso de ferramentas, planejamento), que colaboram para atingir um objetivo definido. Os recursos incrementais da IA agêntica em relação à IA generativa são estruturais:

IA agêntica em produção

A IA agêntica opera hoje em organizações globais que gerenciam milhões de transações diariamente. Para citar alguns exemplos:

Mas o que é um sistema agêntico? Cinco camadas modulares

Estas capacidades funcionais se concretizam em uma arquitetura modular específica (não simplesmente um modelo de linguagem com acesso a ferramentas), composta de cinco camadas interdependentes:

Essa arquitetura torna a autonomia rastreável, auditável e governável. Cada decisão, cada ação, cada invocação de ferramentas é registrada, permitindo uma supervisão humana eficaz e o compliance regulatório.

MCP: o elo perdido para a escalabilidade

A arquitetura agêntica enfrenta um problema técnico fundamental: a complexidade exponencial das integrações. Tradicionalmente, cada modelo de linguagem requer uma integração proprietária com cada ferramenta. A alteração de modelos requer a reescrita de todas as integrações; a adição de uma nova ferramenta requer a integração com todos os modelos existentes. O resultado é uma dívida técnica exponencial.

O Model Context Protocol (MCP) resolve esse problema por meio de uma camada de abstração universal. O MCP é um padrão aberto que padroniza a forma como os modelos de IA interagem com aplicativos externos, fontes de dados e ferramentas. Os "servidores MCP" expõem recursos (recursos, prompts, ferramentas) que os "clientes MCP" (agentes ou modelos) consomem sob demanda. Uma ferramenta conectada à MCP é imediatamente acessível a qualquer agente atual ou futuro, sem a necessidade de redesenvolver integrações.

O impacto do MCP é transformador: ele passa de integrações feitas à mão para ativos universalmente reutilizáveis, facilita a transição de protótipos isolados para ecossistemas dimensionáveis, permite que os agentes adquiram novos recursos sem reimplantação e reduz drasticamente o custo de manutenção e evolução. Sem o MCP ou padrões equivalentes, a IA agêntica em escala empresarial não é tecnicamente sustentável.

Governança e controle: o verdadeiro desafio

Criar agentes é relativamente simples com as estruturas atuais; governá-los em escala empresarial é o verdadeiro desafio. A adoção sustentável exige o equilíbrio de quatro recursos:

Implicações estratégicas

A adoção da IA agêntica tem três implicações estratégicas fundamentais:

IA em robótica e sistemas físicos

Do digital à ação no mundo real

Durante anos, a robótica industrial operou por meio de sistemas programados para tarefas repetitivas em ambientes altamente controlados: braços robóticos que montam componentes seguindo sequências fixas, veículos guiados automaticamente (AGVs) que seguem rotas predefinidas, sistemas de ”pick and place” que reconhecem objetos em posições exatas. Esses robôs executam movimentos precisos, mas não têm adaptabilidade: qualquer mudança no ambiente (um objeto mal posicionado, uma variação na textura, um obstáculo inesperado) exige reprogramação ou intervenção humana.

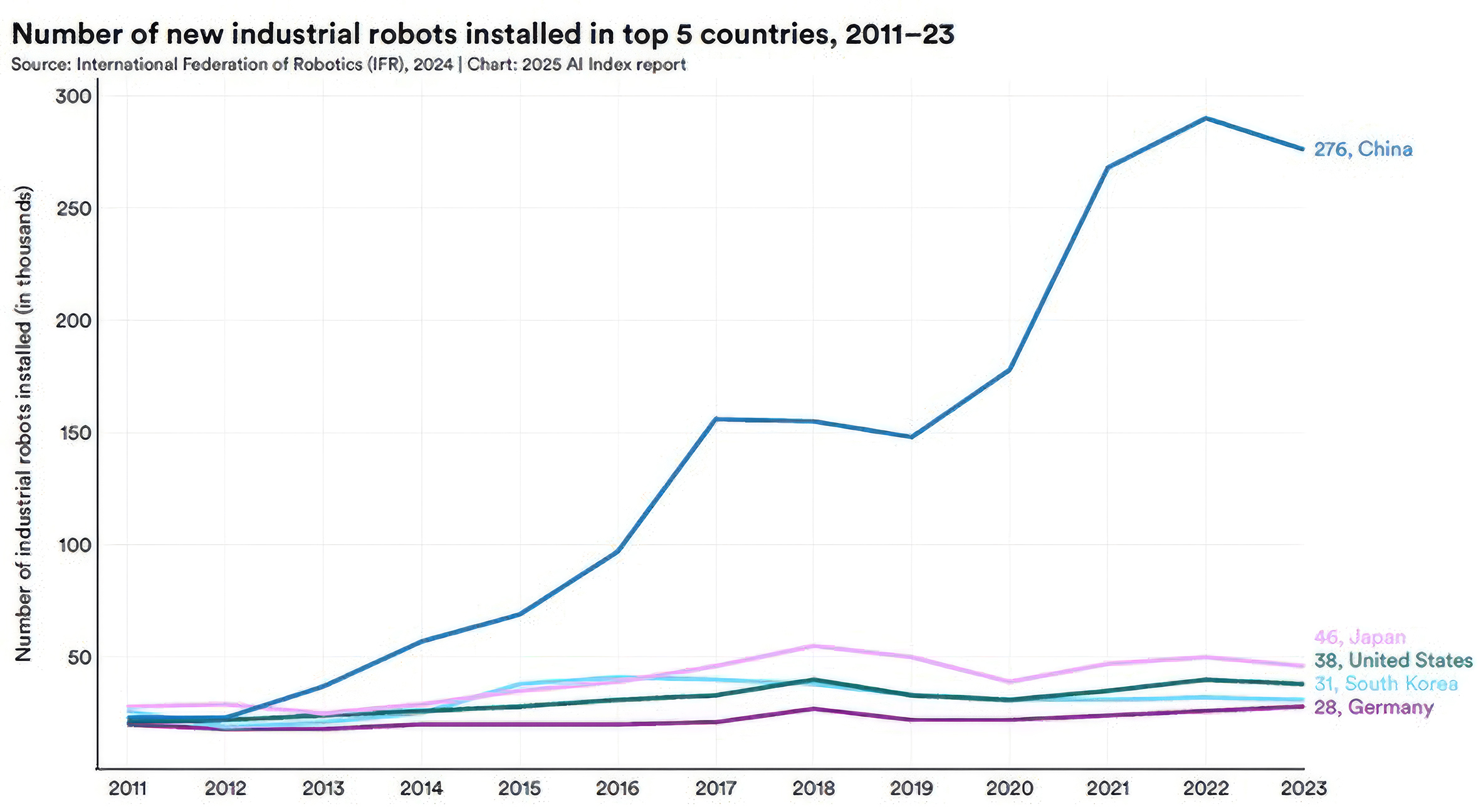

A integração de IA generativa, modelos avançados de visão e aprendizagem por reforço está transformando essa realidade no setor: somente em 2023, mais de 276.000 robôs industriais foram instalados na China (Fig. 2), o que já representa mais da metade das instalações mundiais, e a participação de robôs colaborativos quadruplicou em seis anos. Os robôs atuais percebem seu ambiente por meio de visão computacional em tempo real, interpretam instruções em linguagem natural, planejam sequências complexas de ações, adaptam-se a mudanças imprevistas sem reprogramação e aprendem com cada interação para melhorar continuamente. A IA transforma máquinas industriais rígidas em sistemas autônomos capazes de operar em ambientes não estruturados e executar tarefas que antes exigiam inteligência humana.

Robôs humanoides: do laboratório para o chão de fábrica

A robótica humanoide deu um salto quântico nos últimos dois anos, passando de demonstrações espetaculares em laboratório para implementações industriais reais.

A Figure AI, uma startup avaliada em aproximadamente US$ 39 bilhões, concluiu uma implantação de 11 meses de seus robôs Figure 02 na fábrica da BMW em Spartanburg (Carolina do Sul) em 2025. Os dois robôs humanoides trabalharam em turnos de 10 horas de segunda a sexta-feira, acumulando 1.250 horas de operação, carregando mais de 90.000 peças de chapa metálica com tolerâncias de 5 milímetros em 2 segundos por peça e contribuindo para a produção de mais de 30.000 veículos BMW X3.

A Figure lançou sua terceira geração, a Figure 03, projetada especificamente para produção em volume. A empresa construiu a BotQ, uma instalação dedicada à fabricação de robôs humanoides com capacidade inicial de 12.000 unidades por ano e uma meta de produzir 100.000 robôs em quatro anos. A Figure 03 incorpora carregamento indutivo sem fio (2 kW por meio de bobinas de pé que permitem que o robô simplesmente pise em uma base para recarregar), um sistema de visão reprojetado com o dobro da taxa de atualização e um quarto do tempo de latência, além de câmeras de palma integradas para feedback visual redundante durante a manipulação fina. A empresa projeta que esses robôs operarão usando sua IA proprietária Helix, treinada em massa com dados de teleoperação e demonstrações humanas.

Por sua vez, a Tesla está aumentando agressivamente a produção de seu robô humanoide Optimus. A empresa anunciou planos para construir uma linha de produção capaz de fabricar um milhão de unidades por ano, com início previsto para o final de 2026. Elon Musk declarou em outubro de 2025 que a versão 3 do Optimus terá "mãos que são uma incrível obra de engenharia" com amplitude total de movimento humano (22 graus de liberdade) e que o robô será tão realista que "você precisará tocá-lo para acreditar que é realmente um robô". A Tesla produziu vários milhares de unidades até 2025 para uso interno em suas fábricas (principalmente para manuseio de baterias e componentes) e planeja aumentar para 50.000-100.000 unidades até 2026. Musk estima que, em volumes acima de 1 milhão de unidades por ano, o custo de produção do Optimus cairá abaixo de US$ 20.000, aproximadamente metade do custo de um Modelo Y em escala equivalente. O preço de varejo, no entanto, será significativamente mais alto e determinado pela demanda do mercado.

A Boston Dynamics, referência histórica em robótica dinâmica, aposentou em abril de 2024 seu Atlas hidráulico (famoso por backflips e parkour) e lançou um Atlas totalmente elétrico projetado para aplicações industriais reais. O novo Atlas integra atuadores personalizados de alto desempenho com amplitude de movimento que excede a capacidade humana: sua cabeça e seu tronco podem girar 180 graus independentemente, suas articulações têm extrema flexibilidade e ele foi projetado para explorar sua própria anatomia mecânica, não se limitando a posturas humanas, embora muitos de seus recursos de controle sejam treinados a partir do movimento humano. A Boston Dynamics enfatiza que o Atlas priorizará a velocidade e a eficiência em detrimento da aparência antropomórfica.

Em agosto de 2025, a Boston Dynamics e o Toyota Research Institute demonstraram o Atlas operando por meio de Large Behavior Models (LBMs): políticas completas treinadas com demonstrações extensas e anotações de linguagem que coordenam a locomoção e a manipulação simultaneamente. Um único modelo de comportamento controla diretamente todo o robô, tratando mãos e pés de forma quase idêntica, sem separar o controle de locomoção de baixo nível do controle de manipulação. Em vídeos públicos, o Atlas executa sequências contínuas de tarefas de classificação e embalagem em ambientes simulados de fábrica, reagindo de forma autônoma a distúrbios físicos inesperados (como pesquisadores fechando caixas ou empurrando objetos) sem interromper a tarefa. A Boston Dynamics planeja pilotos com a Hyundai em 2026 e produção comercial limitada a partir de 2027.

Além da manufatura e da logística, a robótica humanóide aponta para uma segunda área de impacto: o cuidado de pessoas idosas, dependentes ou com deficiência. Em economias com envelhecimento estrutural acelerado, esta aplicação tem relevância estratégica comparável à industrial, com implicações éticas e regulatórias próprias que os marcos atuais mal começaram a abordar.

Implicações estratégicas e desafios operacionais

A integração da IA à robótica humanoide introduz mudanças estruturais na fabricação e na logística. A produtividade aumenta drasticamente: os robôs operam 24 horas por dia, 7 dias por semana, sem fadiga, pausas ou variação de desempenho. Os custos operacionais recorrentes (energia, manutenção preventiva) são previsíveis e estão diminuindo com as economias de escala, embora o investimento inicial continue sendo significativo.

No entanto, surgem desafios críticos. O impacto sobre o emprego é real e concentrado: tarefas manuais repetitivas na fabricação, montagem e manuseio de materiais enfrentam uma automação acelerada. As organizações que adotam a robótica humanoide precisam gerenciar as transições de mão de obra, os programas de requalificação e as crescentes expectativas regulatórias e sociais sobre a responsabilidade corporativa, desafios que são comuns à adoção da IA em geral, mas que, neste contexto, assumem maior concentração setorial e visibilidade social

A dependência de fornecedores se intensifica: as empresas que adotam robôs estão vinculadas a seus ecossistemas proprietários de hardware, software, atualizações de IA e suporte técnico. A obsolescência tecnológica é rápida: um robô comprado hoje pode ser superado em termos de recursos pela próxima geração em dois anos, o que levanta questões sobre ciclos de investimento e estratégias de atualização.

E surgem novos riscos operacionais: sistemas autônomos que operam em ambientes físicos compartilhados com humanos podem causar ferimentos, danos à propriedade ou interrupções operacionais críticas se falharem. A robótica com IA exige estruturas de segurança robustas (sensores redundantes, sistemas de desligamento de emergência, zonas de exclusão dinâmicas), protocolos certificados à prova de falhas e supervisão humana eficaz, mesmo em operações nominalmente autônomas.

A IA na robótica não é uma tendência futura, é uma realidade operacional em uma fase de industrialização acelerada. As organizações que avaliarem estrategicamente quando e onde adotar a robótica humanoide (nem todas as tarefas justificam o investimento) obterão vantagens competitivas sustentáveis.

Fig. 2. Robôs industriais recém-instalados. Fonte: Stanford (2025).

|

Índice deconteúdos

Introdução

Resumo Executivo

A explosão da tecnologia de IA

Governança da IA e impacto sobre as pessoas

Fronteiras da IA

Estudo de caso: GenMS™ Sybil

Conclusões

Referências e glossário